Энтропия в психологии что это такое: ваша стабильность зависит от того, сколько неопределенности вы можете терпеть • musanews

ваша стабильность зависит от того, сколько неопределенности вы можете терпеть • musanews

Единственная уверенность в жизни — это изменение. Но это единственная уверенность, которую мы не принимаем. Мы чувствуем себя слишком комфортно с известным. Знакомое заставляет нас чувствовать себя в безопасности, защищенными от невзгод.

Вот почему мы создаем пузыри, в которых живем. Эти пузыри «безопасности» основаны на наших привычках, образе мышления, убеждениях и ценностях. Они подтверждают наш взгляд на мир и самих себя. Они дают нам ощущение постоянства и стабильности.

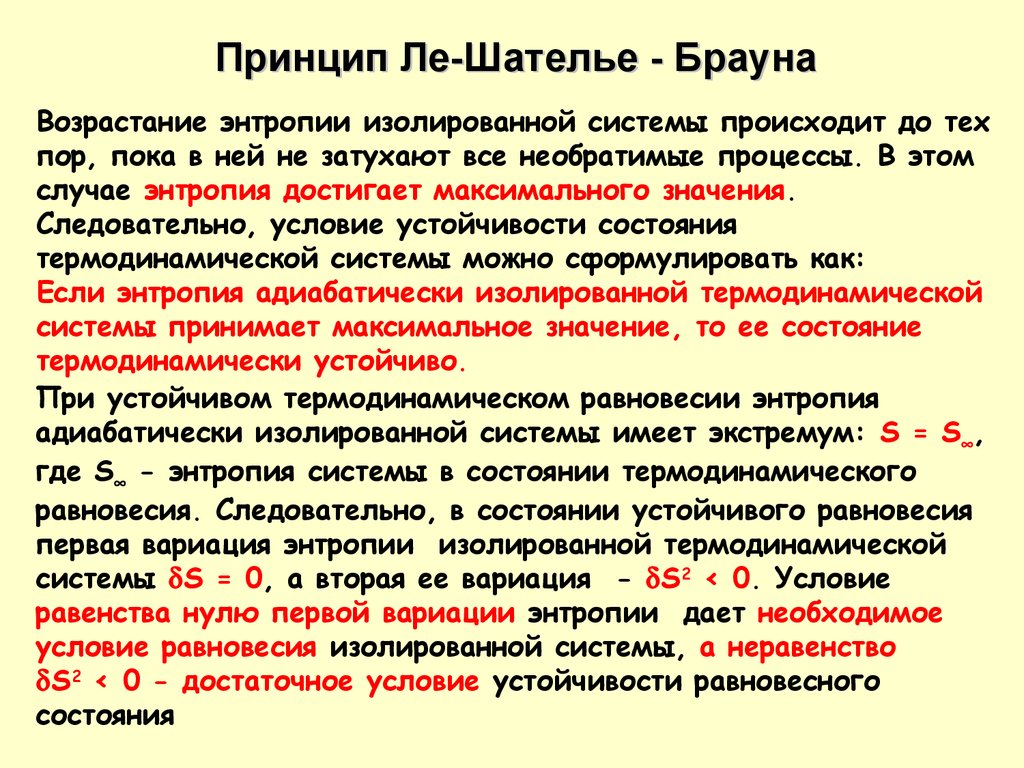

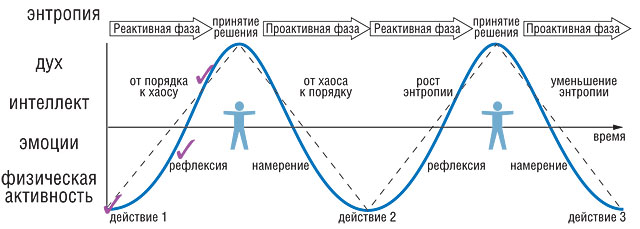

Проблема в том, что эти пузыри не тверже мыльного пузыря. И ментальное равновесие, которое мы находим в них, может быстро уступить место психологической энтропии. Когда мир вокруг нас меняется и становится неуверенным, у нас есть два варианта: погрузиться в энтропию или возродиться с новым балансом. Прямо сейчас мы находимся в состоянии глубокой психологической и социальной энтропии.

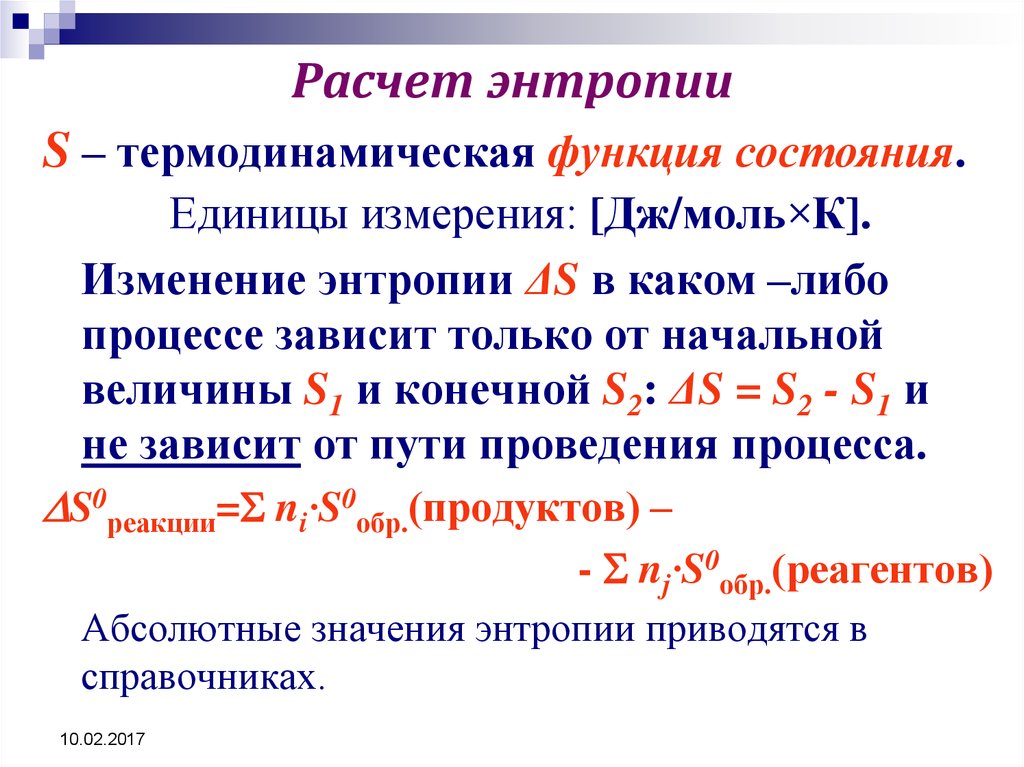

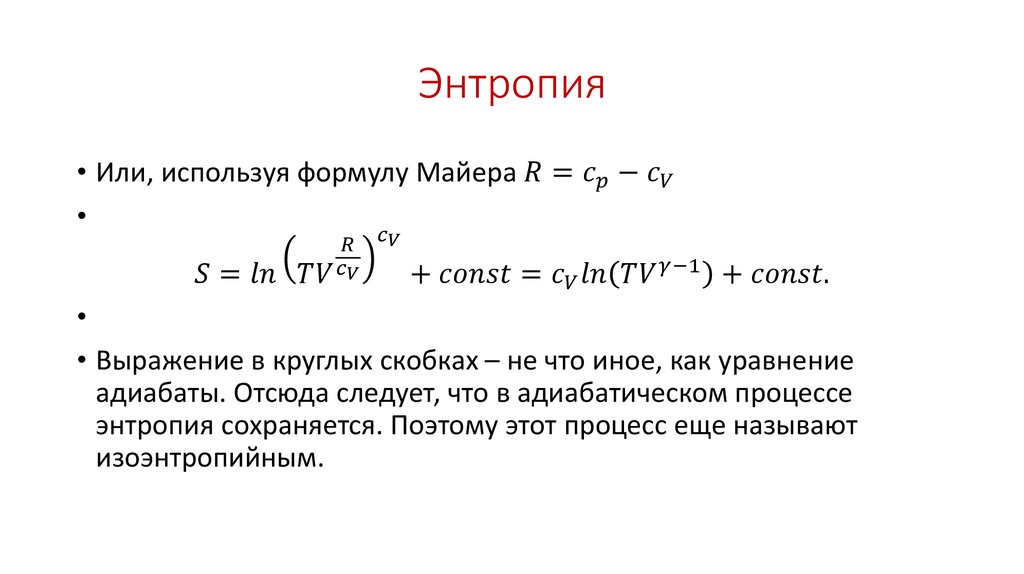

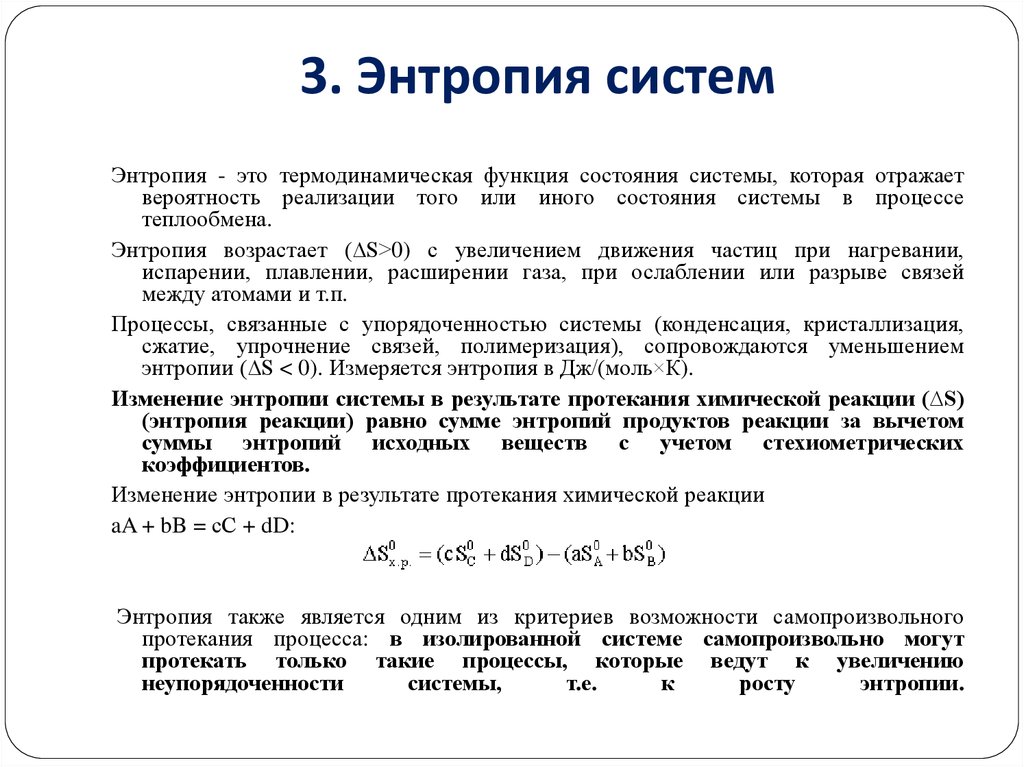

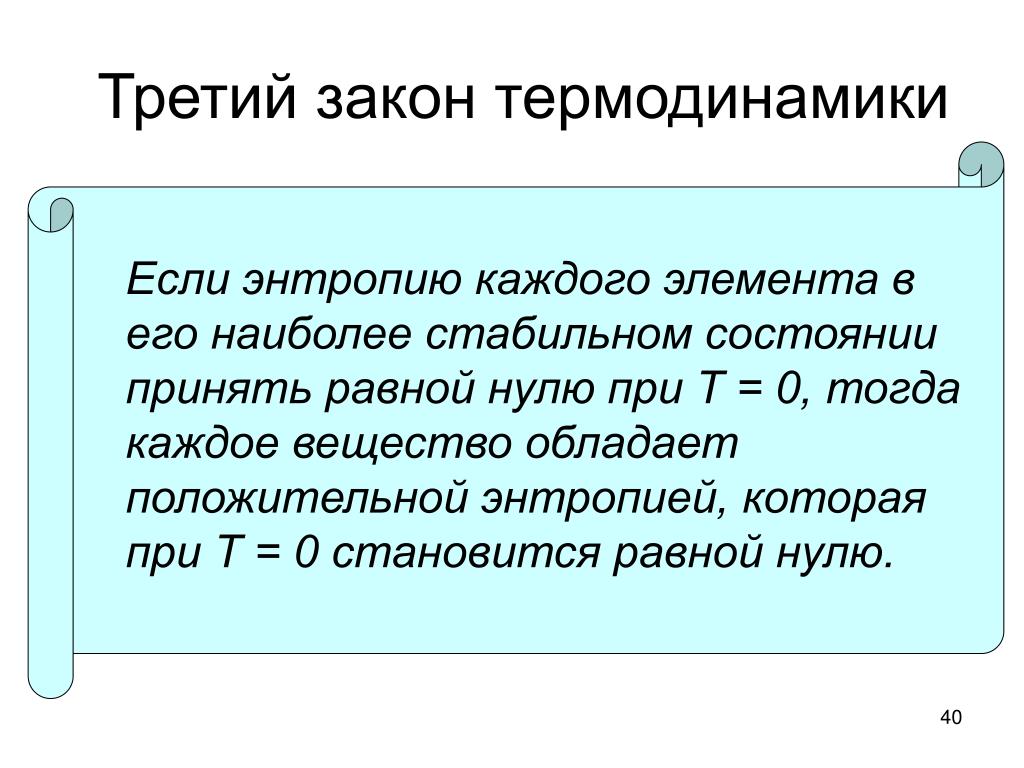

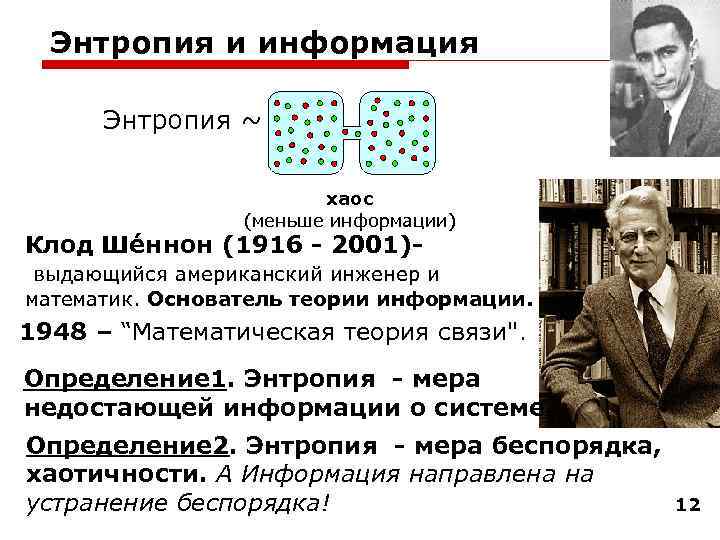

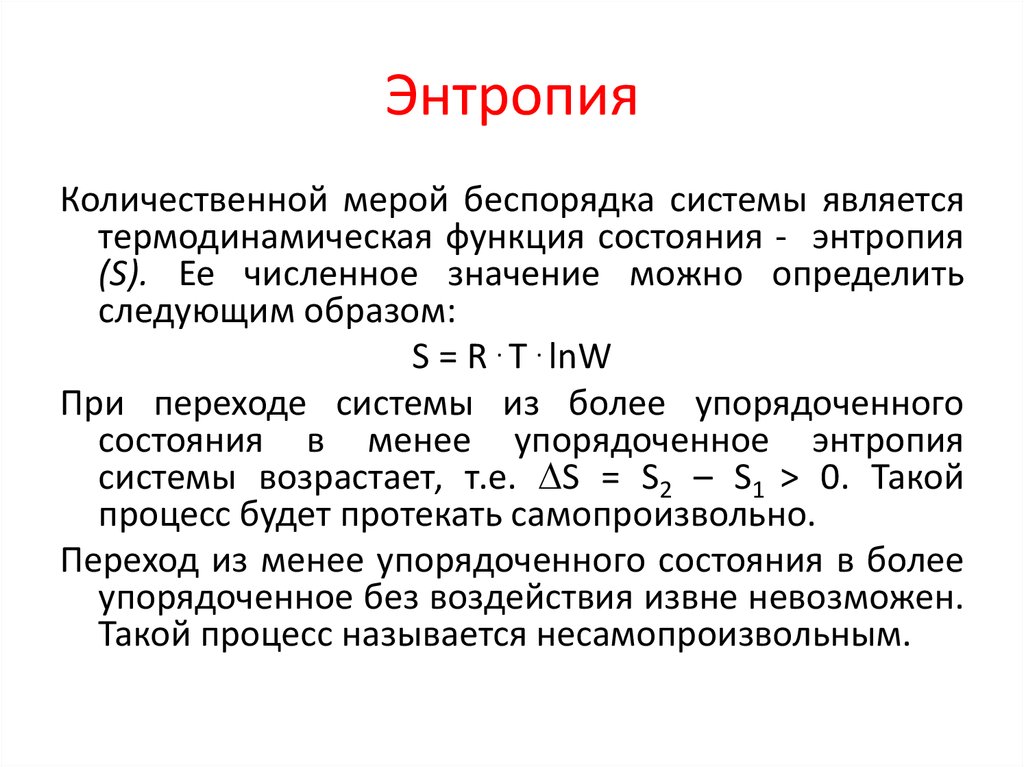

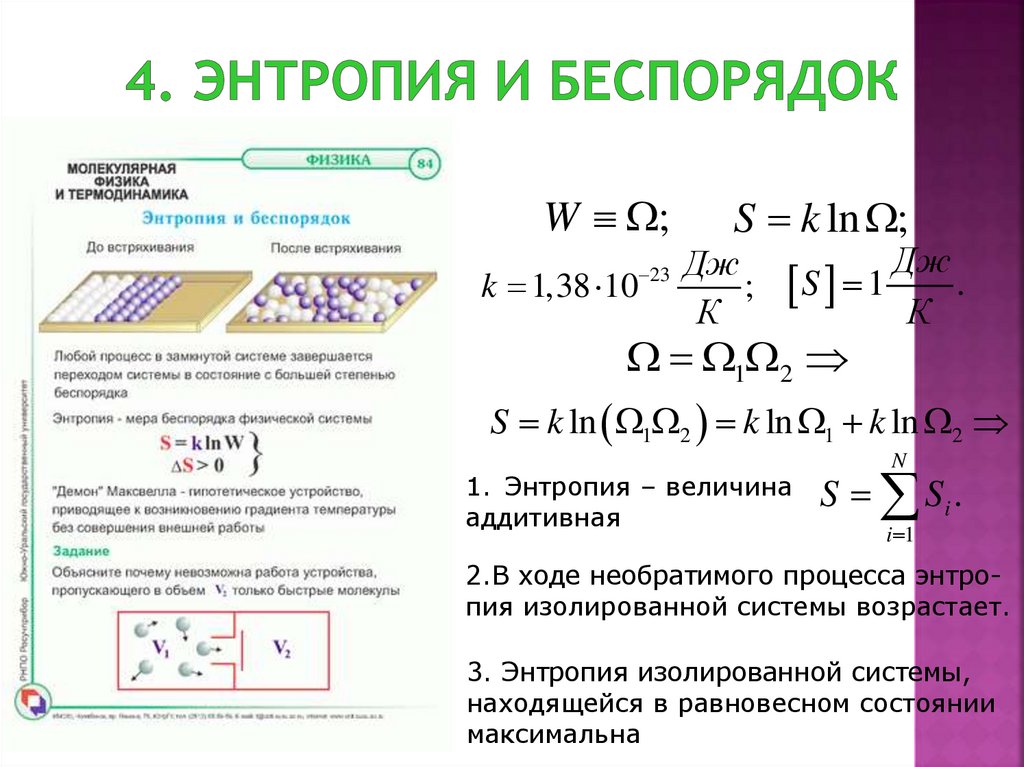

Что такое энтропия в психологии?Энтропия — это концепция, полученная из термодинамики, согласно которой все системы склонны к хаосу и беспорядку. В психологической сфере эта концепция описывает степень неопределенности и беспорядка, существующую в системе.

В психологической сфере эта концепция описывает степень неопределенности и беспорядка, существующую в системе.

— Рекламное объявление —

Карл Юнг считал, что законы физического сохранения энергии применимы и к нашей психике. Он сказал, что когда есть переизбыток энергии в одной из наших психологических функций, это означает, что другая функция лишена ее, что создает дисбаланс.

Однако он указал, что наш разум имеет тенденцию включать компенсирующие механизмы, чтобы избежать полной энтропии и поддерживать некоторую стабильность. THE Защитные механизмы являются примером этой попытки компенсации. Когда реальность становится неприемлемой, мы активируем барьер, чтобы защитить свое эго и сохранить образ, который мы о себе сформировали.

Неопределенность как мера психологической энтропииОдним из критериев оценки уровня беспорядка в системах, в том числе в нашем сознании, является неопределенность: — степень, в которой мы можем знать, как устроены различные компоненты системы в данный момент.

Например, в не перетасованной колоде карт мы можем точно знать, как расположены карты. Если мы разрежем колоду и увидим червовый туз, мы узнаем, что карта ниже — это червовая двойка. Но если мы перетасуем колоду, мы снизим эту уверенность до такой степени, что больше не сможем надежно предсказать, какая из оставшихся карт находится под этим тузом червей. Полностью перемешанная колода представляет собой систему максимальной энтропии.

Все, что составляет нашу жизнь, похоже на ту колоду карт. Приятно быть уверенным, что наш партнер будет ждать нас дома. Удачной работы. Зная, что с людьми, которых мы любим, все в порядке. Знайте точное время отправления автобуса или самолета …

Однако правила игры могут измениться в любой момент, как нам показала эта пандемия или что происходит, когда мы переезжаем в другую страну. В таких случаях наши когнитивные схемы, ментальная карта мира, которую мы сформировали, недостаточны для предсказания того, что произойдет.

В этот момент мы обычно впадаем в состояние максимальной умственной энтропии. Внешний хаос разрушает наш внутренний мир. Поскольку нам больше не нужно держаться за что-то, мы становимся некритичными и рассматриваем все восприятия, от самого конкретного объекта до самой эфемерной иллюзии, как равнозначные представления реальности. Когда мы не уверены, все возможно.

Внешний хаос разрушает наш внутренний мир. Поскольку нам больше не нужно держаться за что-то, мы становимся некритичными и рассматриваем все восприятия, от самого конкретного объекта до самой эфемерной иллюзии, как равнозначные представления реальности. Когда мы не уверены, все возможно.

Когда мы не можем мириться с неопределенностью, потому что она разрушает фундамент, на котором мы строили нашу повседневную жизнь, наш идеальный внутренний мир начинает распадаться. Итак, у нас есть две возможности.

Первый — погрузиться в хаос и позволить энтропии править, и в этом случае у нас, скорее всего, разовьются такие расстройства, как тревога, депрессия или даже психоз. Действительно, было высказано предположение, что неспособность проанализировать интерпретирующие структуры после травмы может объяснить начало посттравматического стрессового расстройства. Это нарушение было бы результатом нашей неспособности создать организованный рассказ о травме, который наводит порядок в нашем мире.

Вторая альтернатива — стремиться снизить уровень энтропии до тех пор, пока мы не достигнем точки оптимального баланса, которая позволяет нам терпеть неопределенность по мере нашего развития, восприятие мира достаточно предсказуемо, чтобы позволить нам продолжать нашу жизнь.

Мы должны помнить, что неопределенность всегда ставит перед нами серьезную адаптационную проблему, которая, теоретически, должна побуждать нас принимать меры, чтобы удерживать ее на управляемом уровне. Согласно Юнгу, именно в эти моменты происходят самые радикальные изменения.

— Рекламное объявление —

Этот психоаналитик считал, что, когда мы переживаем важное событие, которое ставит под сомнение некоторые из наших наиболее устоявшихся гипотез или убеждений, наше равновесие резко меняется. В это время для нас нормально чувствовать беспокойство, тревогу и дезориентацию. Как будто мы переживаем психологическое землетрясение.

После борьбы с этими новыми идеями, представлениями или ломбер, наконец, сформированы новое отношение, система убеждений, стиль мышления или адаптации. Мы достигаем нового баланса, который обычно более обогащает, чем предыдущий. Любопытно, что эта новая формация будет тем более прочной, чем больше она будет отклоняться от первоначального отношения.

Мы достигаем нового баланса, который обычно более обогащает, чем предыдущий. Любопытно, что эта новая формация будет тем более прочной, чем больше она будет отклоняться от первоначального отношения.

В жизни царит хаос и неопределенность, нет ничего предсказуемого и безопасного на 100%. Однако часто мы сопротивляемся принятию неопределенности. Это сопротивление только ухудшит энтропию.

Сопротивление переменам предполагает постоянные страдания. Фактически, исследование, проведенное в Университете Торонто, показало, что наш мозг обрабатывает неопределенность так же, как и тревогу. Это означает, что в конечном итоге он представит нам счет.

Одна из стратегий минимизации влияния неопределенности и защиты нашего психологического баланса — это разработка гибких интеллектуальных карт нашего окружения, которые проведут нас через хаос для достижения наших самых важных целей. Когда условия меняются, одержимость деталями заставляет нас тратить драгоценную энергию. Вместо этого нам нужно быстро изменить карту разума, чтобы сосредоточиться на действительно важных целях в нашей жизни. Так что у нас будет плацдарм посреди бури.

Вместо этого нам нужно быстро изменить карту разума, чтобы сосредоточиться на действительно важных целях в нашей жизни. Так что у нас будет плацдарм посреди бури.

В любом случае, хотя всем нам нужна определенная степень когнитивной уверенности и предсказуемости, мы также должны признать, что являемся частью естественной и социальной среды, которая подвержена постоянным изменениям и имеет хаотический и нестабильный компонент. Энтропия — не наш враг, это дополнительная особенность нашего разума, природы и Вселенной.

Самоорганизующиеся системы, такие как мы, вовлечены в постоянный диалог с окружающей средой и должны адаптироваться к меняющимся обстоятельствам, чтобы поддерживать внутреннюю энтропию на управляемом уровне. То есть, если мы не в состоянии мириться с неопределенностью в мире, любые изменения психологически дестабилизируют нас.

Как сказал Уильям Джеймс, наша внутренняя жизнь непостоянна, беспокойна, непостоянна, постоянно находится в переходном состоянии. Эти переходы реальны, мы живем в переходах, потому что все постоянно меняется.

Следовательно, мы должны признать, что мы — баланс и хаос. Стабильность и перемены. Предполагая, что эти изменения являются частью жизни и способствуют большему благополучию. Парадоксально, но чем больше мы принимаем хаос, тем ближе мы к безмятежности. Главное — принять то, что мы не можем изменить, и трансформировать себя, чтобы лучше адаптироваться к каждому внешнему требованию.

источники:

Чжан, В. и Го, Б. (2017) Разрешение защитных механизмов: перспектива, основанная на теории диссипативной структуры. Int J Психоанальный; 98 (2): 457-472.

Hirsh, JB et. Ал. (2012) Психологическая энтропия: основа для понимания тревоги, связанной с неопределенностью. Psychol Rev; 119 (2): 304-20.

Юнг, CG (1960) La estructura y dynámica de la psiquis, Vol. 8. Princeton: Princeton University Press.

Вход Психологическая энтропия: ваша стабильность зависит от того, сколько неопределенности вы можете терпеть. был впервые опубликован в Уголок психологии.

был впервые опубликован в Уголок психологии.

что это такое простыми словами

В современном мире статистическая наука является неотъемлемой частью в жизни каждого общества. Она дает возможность определить динамику развития любого явления или процесса. Одной из вероятностных статистических величин, с помощью которой можно объяснить практически все процессы человеческой жизнедеятельности как социальные, так и индвидуальные, является энтропия. Что же означает простыми словами этот многогранный термин?

Содержание:

- Определение

- История возникновения

- Виды энтропии

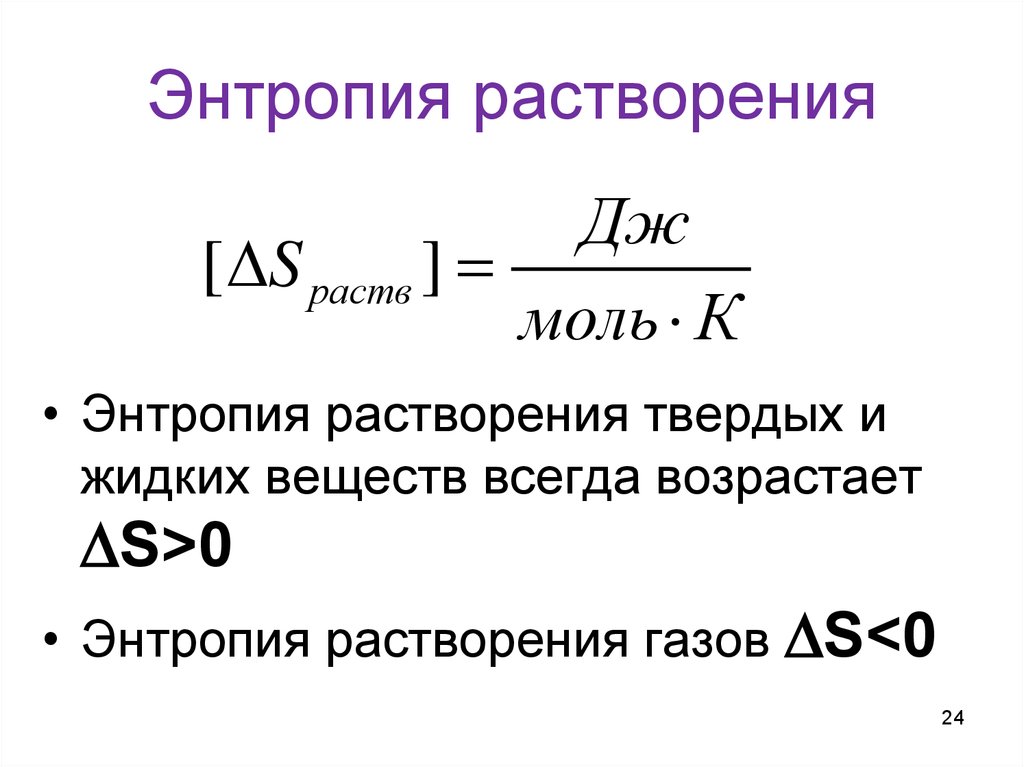

- В термодинамике

- В экономике

- В информатике или статистической физике

- В социологии

- Примеры

Определение

Энтропия (в переводе с древнегреческого – поворот, превращение) – это мера, степень неупорядоченности (хаоса) какой-либо системы. Используется в следующих точных и естественных науках:

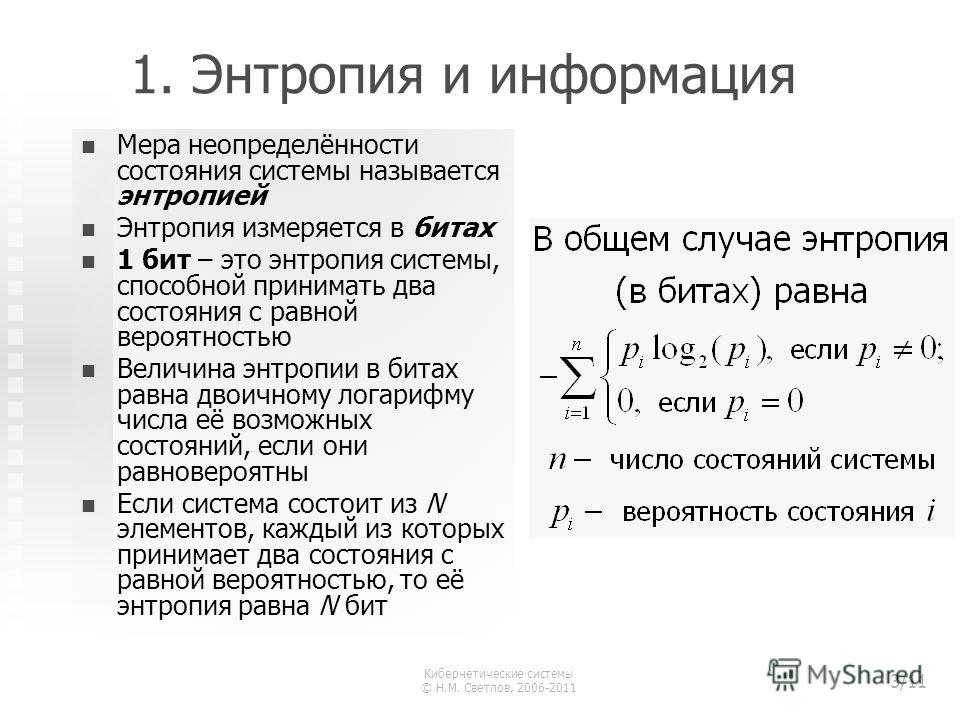

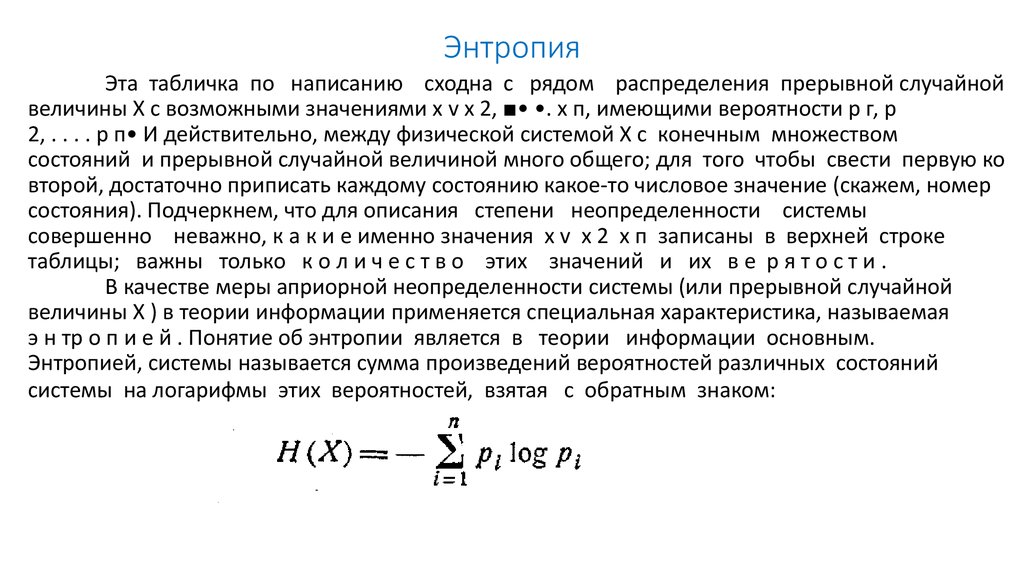

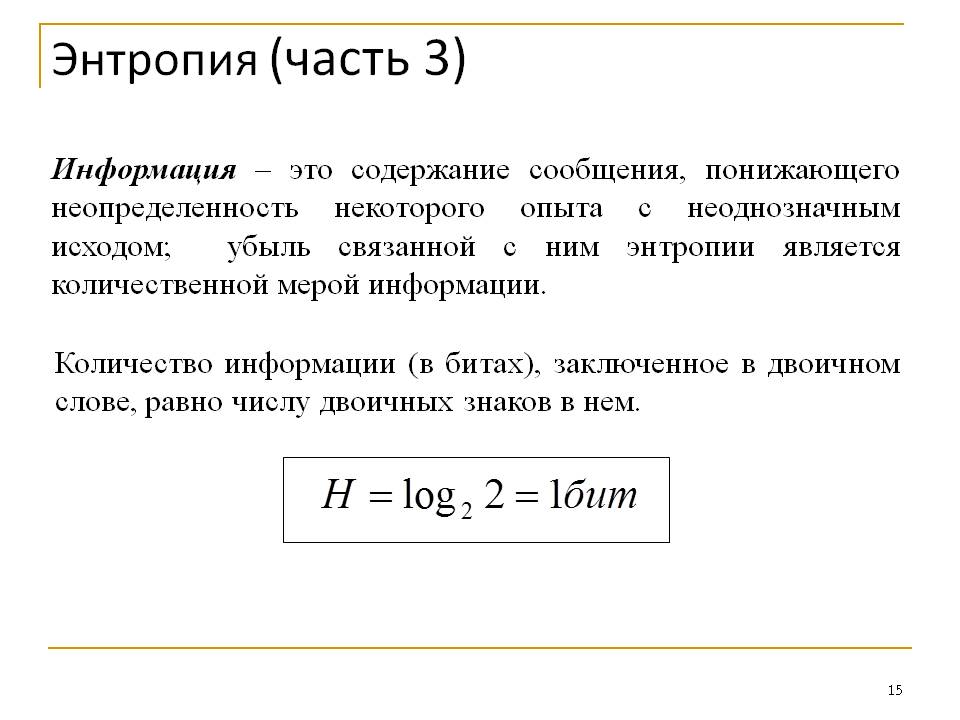

- В математике означает поиск логарифма числа доступных состояний системы;

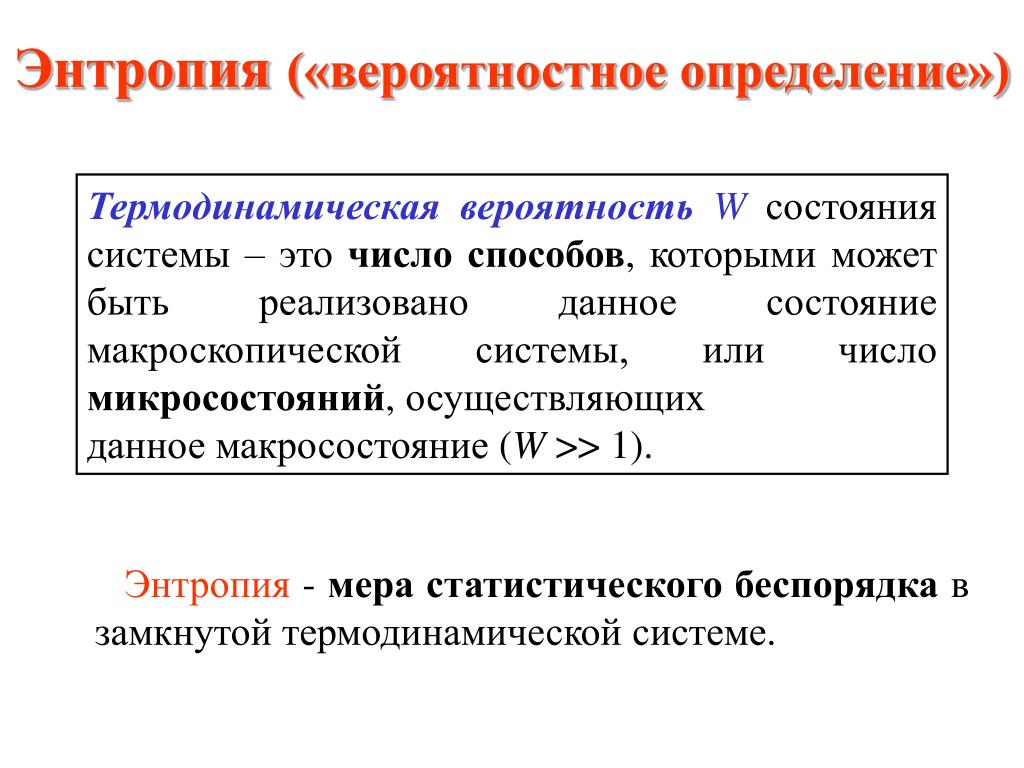

- В статистической науке – вероятностная величина наступления любого макроскопического состояния системы;

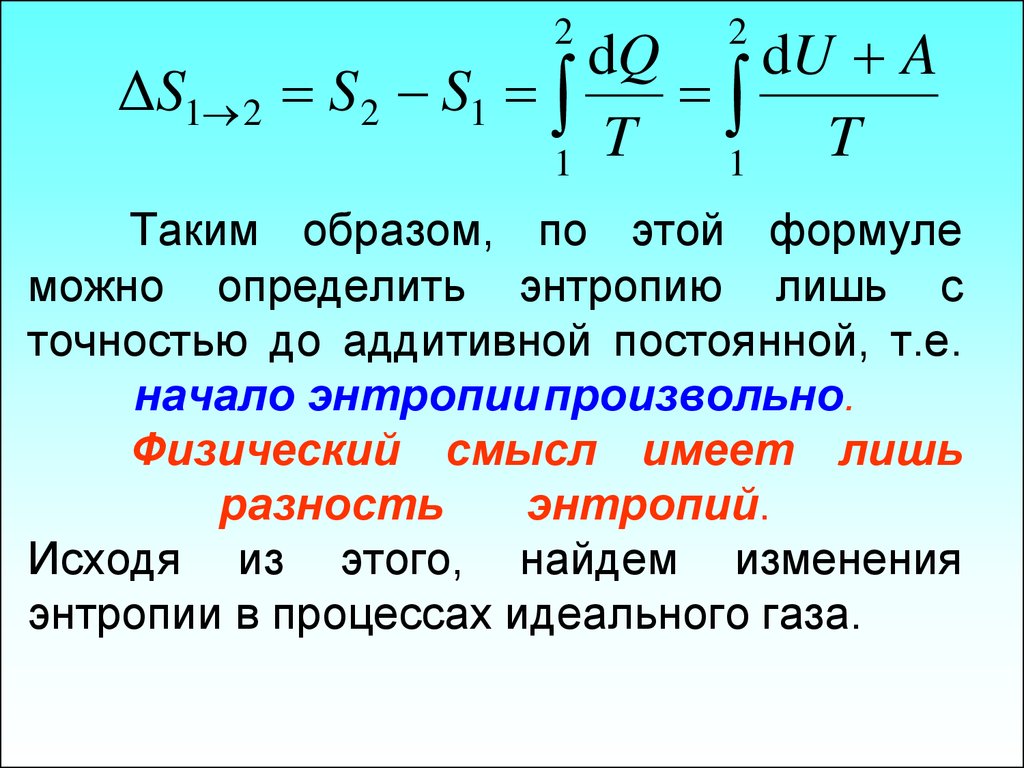

- В термодинамике (физика) – степень необратимой диффузии энергии, т.

е. стандартная величина ее потерь, которые неизбежны при взаимодействии более горячего тела с более холодным;

е. стандартная величина ее потерь, которые неизбежны при взаимодействии более горячего тела с более холодным; - В информатике – означает информационную емкость системы. Интересным фактом является следующее: Клод Шеннон (основоположник этого термина в информационной теории) первоначально думал назвать энтропию информацией.

История возникновения

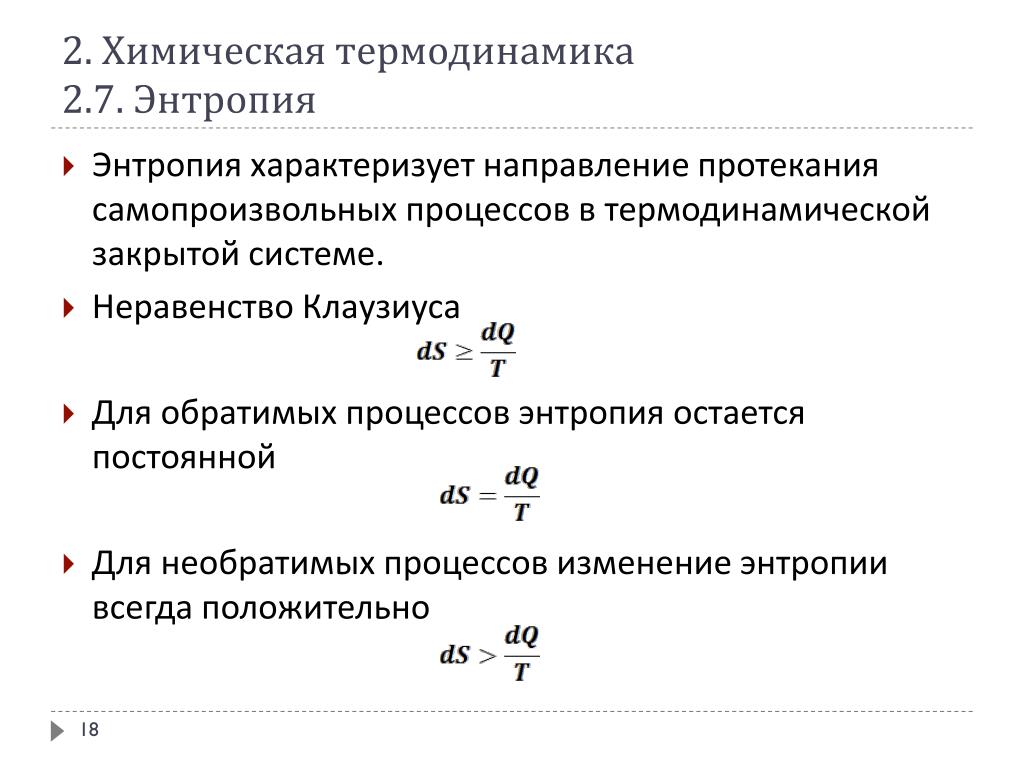

Впервые понятие энтропии было введено в эпоху развития термодинамики, когда возникла необходимость в изучении процессов, происходящих внутри термодинамических тел. В 1865 году ученый-физик из Германии Рудольф Клаузиус этим термином описал состояние системы, в котором теплота имеет способность преобразовываться в иные виды энергии (механическую, химическую, световую и т.д.).

Прирост энтропии вызван притоком тепловой энергии в систему и связан с температурой, при которой этот приток возникает. Необходимость этой величины была вызвана тем, что вся физика строится на идеализации абстрактных объектов (идеальный маятник, равномерное движение, масса и т. д.).

д.).

В бытовом понимании энтропия представляет собой степень хаотичности и неопределенности системы: чем больше в системе упорядоченности, и чем больше ее элементы подчинены какому-либо порядку, тем меньше энтропия.

Пример: Шкаф – это определенная система. Если в нем все вещи лежат на своих местах, то энтропия меньше. Если же все вещи разбросаны и лежат не на своих полках, то соответственно она становится больше.

С этим термином тесно связана тепловая функция энтальпии – характеризует состояние термодинамической системы в состоянии равновесия при выборе ряда независимых переменных, таких как давление, энтропия и число частиц.

Величина, противоположная энтропии, называется экстропией.

Виды энтропии

Области применения:

- физическая химия;

- экономические науки;

- статистическая физика или информационная теория;

- социологическая наука.

Рассмотрим подробнее виды энтропии в каждой из областей ее применения.

В термодинамике

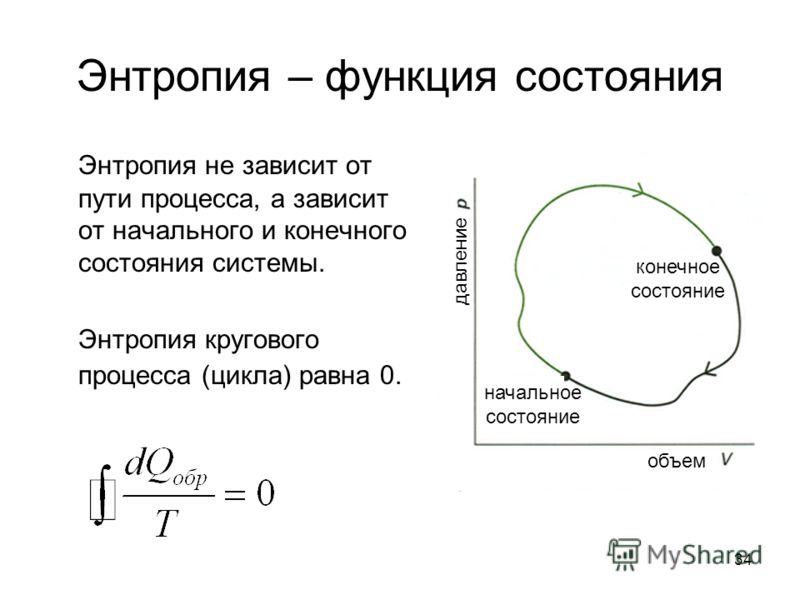

В термодинамике (физической химии) энтропия – это та степень, в которой реальный процесс отклоняется от идеального. Основной постулат термодинамики, сформулированный физиками на базе изучения энтропии: каждая система термодинамики, которая изолирована от внешнего мира, постепенно становится равновесной и впоследствии не имеет возможности выйти самостоятельно из состояния равновесия. Беспорядок – основная характеристика состояния любой системы. Из него она стремится к равновесию.

Возникает вопрос: с помощью чего определить степень беспорядка?

Основной метод: каждому возможному состоянию системы присваивается число вариантных комбинаций, которыми это состояние может быть реализовано.

Вывод: чем больше число вариантов, тем больше величина энтропии. Чем больше организованности в структуре вещества, тем меньше его неупорядоченность.

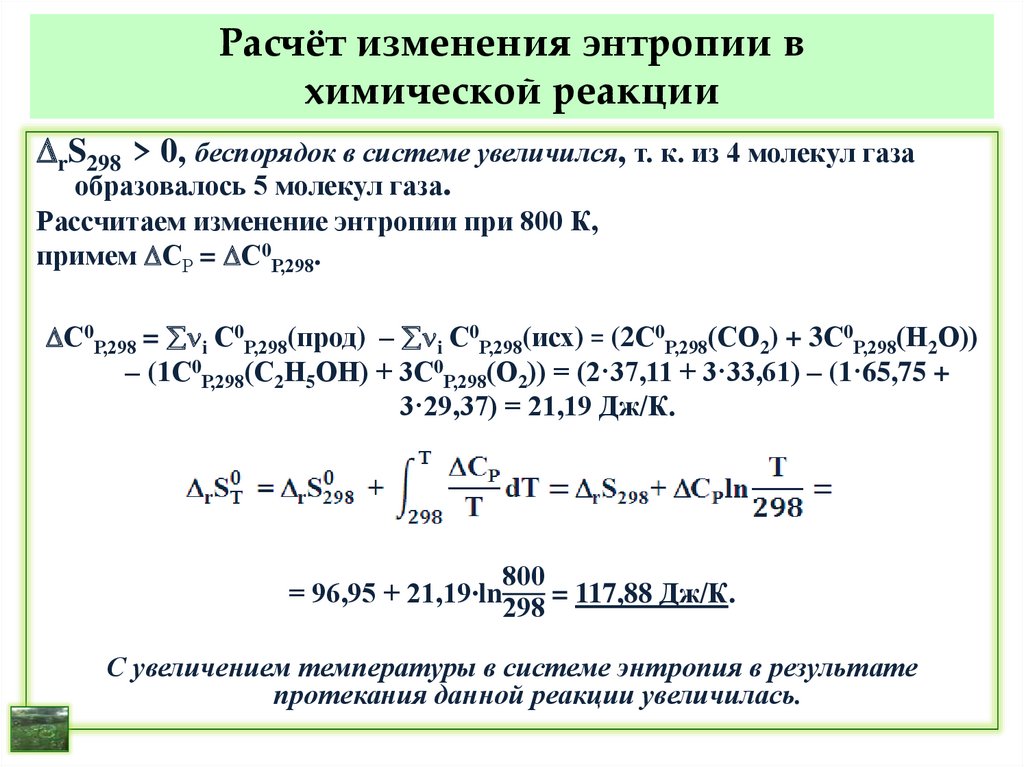

Абсолютная величина энтропии равна приращению имеющейся в системе тепловой энергии в условиях теплопередачи при заданной температуре.

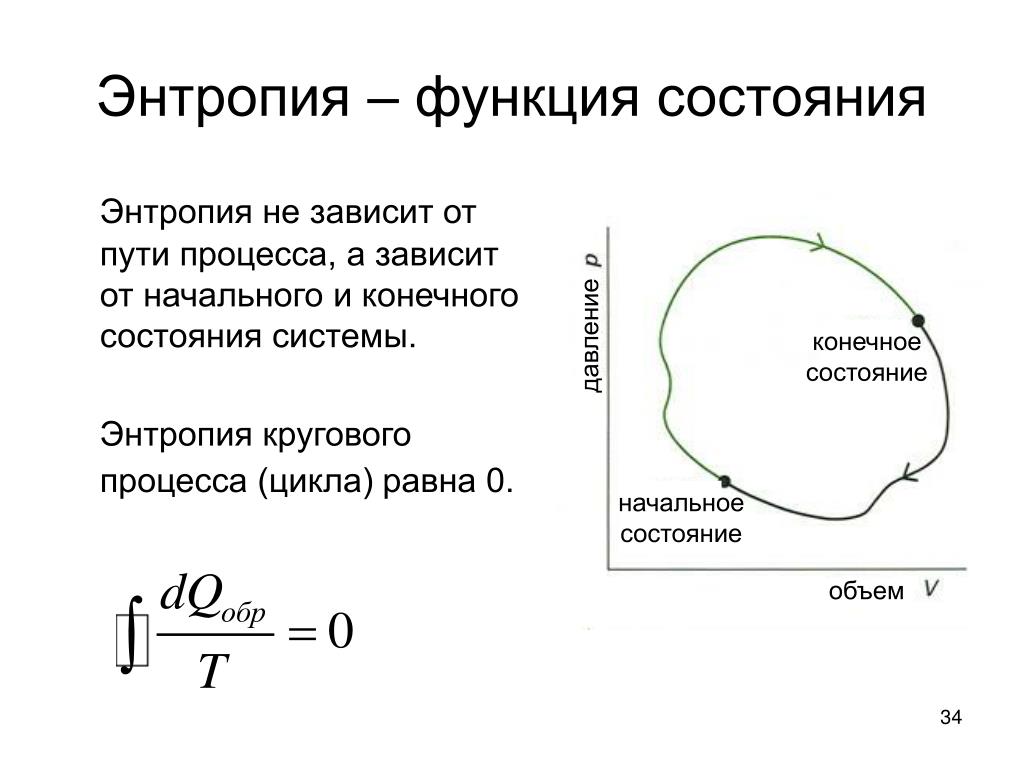

Клазиус определял энтропию как совокупность приведенных тепловых энергий, как функцию состояния системы, которое остается неизменным в условиях замкнутости, а в условиях открытых необратимых процессов – оно всегда положительно изменяется. Ее значение отражает связь между макро- и микросостояниями. Это единственная функциональная величина, показывающая направленность процессов. Но она не показывает сам процесс перехода состояний из одного в другое, а находится лишь исходным и итоговым состоянием системы.

В экономике

Коэффициент энтропии дает возможность проанализировать уровень концентрации рынка и его изменение. Чем этот коэффициент ниже, тем меньше неопределенность внешней среды, что ведет к повышению вероятности возникновения монополий. Этот показатель выступает в качестве косвенного помощника в оценивании выигрыша, который получает предприятие в ходе ведения монополистической деятельности или в условиях изменения рыночной концентрации (влияет на число потенциальных конкурентов фирмы).

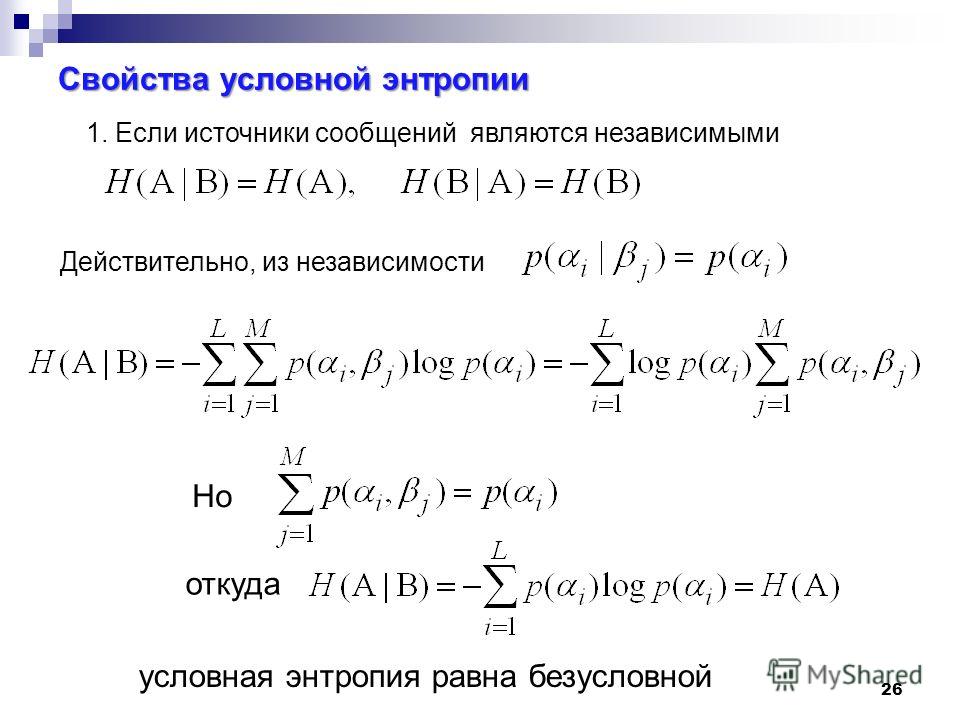

В информатике или статистической физике

Информационная энтропия – это степень непредсказуемости информационной системы. Этот показатель служит для определения степени хаотичности эксперимента, который проводится или произошедшего события. Значение хаотичности прямопропорционально числу состояний, нахождение системы в которых возможно. Все действия, направленные на упорядочивание системы, ведут к появлению информационных сведений о ней и снижают информационную неопределенность, которая выявляет пропускную способность информационного канала, обеспечивающую надежность и достоверность передачи информационных данных. Это позволяет прогнозировать частично возможный ход эксперимента, т.е. предсказывать вероятность того или иного события.

Пример: расшифровка закодированного текста. Для этого анализируется вероятность возникновения того или иного символа и высчитывается величина их энтропии.

В социологии

Энтропия – показатель, характеризующий отклонение общественной системы или ее составных частей от заданного (образцового) состояния. Проявления этого отклонения:

Проявления этого отклонения:

- уменьшение эффективности общественного развития и жизнедеятельности общества как целостной системы;

- снижение способности к самоорганизации.

Пример: персонал организации настолько загружен бумажной работой (составлением отчетов, ведением документации), что не может успевать выполнять свои должностные функции и обязанности (осуществление аудита). Мера неэффективного использования трудовых ресурсов собственником предприятия – это информационная неопределенность.

Примеры

Из бытовой жизни:

- При написании sms-сообщений на мобильном телефоне мы часто пользуемся программой Т9. Чем меньше ошибок в печатаемом нами слове, тем процесс его распознания программой будет легче и она быстрее предложит нам его замену. Вывод: чем больше беспорядка, тем больше информационная неопределенность.

- Когда мы бросаем два кубика при игре в кости, существует только один способ выкинуть комбинацию 2 или 12 (1 и 1, 6 и 6).

Самое максимальное число способов выкинуть число 7 (6 вероятных комбинаций). Непредсказуемость в данном случае будет максимальной.

Самое максимальное число способов выкинуть число 7 (6 вероятных комбинаций). Непредсказуемость в данном случае будет максимальной. - Информация о количестве учеников больше в течение урока, чем во время перемены. Поскольку на уроке каждый ученик сидит на своем месте, то энтропия ниже. За пределами класса для передвижения школьников характерна хаотичность, что ведет к увеличению значения энтропии.

- Если прибрать на рабочей парте, разложить предметы по своим местам, то можно больше получить информации о том или ином предмете, находящемся на ней. Упорядоченность вещей на парте снижает величину энтропии.

Важно! Все, что нас окружает, имеет стремление повысить энтропию. Человек намерен получить из окружающего мира максимальное количество информации. Все теоретические направления изучения энтропии (в физике, химии, экономике, математике, социологии) имеют целью установить баланс (равновесие) между намерениями и желаниями людей и естественными процессами, которые происходят в природе.

Энтропия: почему жизнь кажется такой сложной: bdsmn — LiveJournal

#привычки, #жизненные_уроки, #саморазвитие, #жизнь, #психология, #личностный_рост, #энтропияКак бы мы ни старались улучшить свою жизнь, кажется, что с каждым днём она становится всё сложнее и сложнее.

В сферах семьи, финансов, работы, здоровья и так далее постоянно возникают проблемы, которые кажутся неразрешимыми. Мы устали от бесконечной атаки жизненных проблем, и нам часто кажется, будто наша жизнь рушится.

Почему нам всегда кажется, будто жизнь поймала нас в ловушку? Почему она порой является невыносимой?

Ответы на эти вопросы можно найти в одном важном понятии физики и химии. Речь идёт об энтропии.

Что такое энтропия и почему она так важна?

Вот простая аналогия, которая объясняет энтропию простыми терминами.

Представьте себе, что вы строите замок из песка на пляже.

Через несколько часов ваши усилия увенчались успехом. Вам удалось соединить миллионы отдельных песчинок и слепить из них красивую структуру.

Вы встаёте, отряхиваетесь и уходите. Вы надеетесь снова увидеть свой замок из песка на следующий день.

А теперь представьте себе следующее: ночью была сильная гроза; дождь, ветер и волны омывали песок на пляже.

На следующий день вы возвращаетесь на пляж, чтобы полюбоваться своим песчаным замком, но видите, что от него осталась только половина, вторая была нещадно разрушена.

Это аналогичное переживание энтропии.

Замок из песка представляет собой порядок и структуру в вашей жизни, а гроза символизирует внешние природные силы, которые создают беспорядок, разрушающий замок.

Если рассматривать это с точки зрения науки, то, согласно второму закону термодинамики – одному из самых фундаментальных законов природы – энтропия (мера беспорядка) во Вселенной неуклонно возрастает. Говоря языком обывателя, вещи в нашей жизни естественным образом становятся беспорядочными, если их предоставить самим себе.

Решающее значение энтропии было отмечено в 1915 году физиком сэром Артуром Эддингтоном, который написал:

«Я думаю, что закон, согласно которому энтропия всегда возрастает, занимает самое высокое положение среди законов природы. Если кто-то скажет вам, что ваша любимая теория вселенной не согласуется с уравнениями Максвелла, тем хуже для уравнений Максвелла. Если обнаружится, что она противоречит наблюдениям – что ж, экспериментаторы иногда всё путают. Но если ваша теория окажется противоречащей второму закону термодинамики, я не могу дать вам никакой надежды; ей ничего не остается, как пасть в глубочайшем унижении».

Если кто-то скажет вам, что ваша любимая теория вселенной не согласуется с уравнениями Максвелла, тем хуже для уравнений Максвелла. Если обнаружится, что она противоречит наблюдениям – что ж, экспериментаторы иногда всё путают. Но если ваша теория окажется противоречащей второму закону термодинамики, я не могу дать вам никакой надежды; ей ничего не остается, как пасть в глубочайшем унижении».

Энтропия в повседневной жизни

«Беспорядок, или энтропия, всегда увеличивается со временем. Другими словами, это одна из форм закона Мерфи: всё всегда идёт не так, как надо!» – Стивен Хокинг «Краткая история времени»

Мы каждый день имеем дело с энтропией, даже не подозревая об этом: кипящая вода, охлаждение объектов, таяние льда, растворение соли или сахара.

Как бы там ни было, энтропия способна также объяснить беспорядок и сложности в повседневной жизни. Вот несколько примеров:

Энтропия в области здоровья и физической формы. Естественно, когда мы становимся старше, наши тела склонны разрушаться, пока мы не умрём. Но скорость снижения нашего здоровья зависит от уровня энтропии.

Но скорость снижения нашего здоровья зависит от уровня энтропии.

Например, предположим, что вы поставили перед собой цель сбросить лишний вес и привести себя в форму. В течение двух месяцев вы регулярно выполняете физические упражнения и придерживаетесь здорового питания, избавляетесь от лишнего жира и чувствуете себя лучше.

Но на третий месяц вы отправляетесь в отпуск и нарушаете свою здоровую рутину. Со временем вы набираете вес, теряете мышечную массу и начинаете болеть, что лишь ухудшает состояние вашего организма.

Энтропия в браке. Некоторое время до и после брака пары испытывают волнующие чувства любви и счастья. Это то, что называется «фазой медового месяца».

Но со временем, когда пара погружается в повседневную рутину, приоритет отдаётся другим вещам: воспитанию детей, финансам, работе, здоровью и так далее.

Через несколько лет страсть и романтические чувства, как правило, угасают, пока в браке не останется любви.

Энтропия в бизнесе. В погоне за большим объёмом продаж и прибылью организации, как правило, теряют стратегическую направленность и ясность.

Возникает путаница относительно миссии, конкурентного преимущества, целевой аудитории и направления деятельности организации.

В конечном счёте, организация теряет свою клиентскую базу из-за конкурента с чёткой стратегией, прибыль падает, бизнес банкротится.

Короче говоря, энтропия – это скрытая сила, которая усложняет жизнь. Так же, как и закон гравитации, она действует всегда, чтобы создать беспорядок в повседневной жизни.

Всё рушится без усилий

«Конечная цель жизни, разума и человеческих устремлений: использовать энергию и информацию для борьбы с потоком энтропии и создания убежищ полезного порядка». – Стивен Пинкер

Мы часто обвиняем себя, других и обстоятельства в проблемах, возникающих в нашей жизни, но мы не осознаём того, что силы природы активно работают против наших лучших интересов.

Энтропии нет дела до ваших целей и стремлений. Она заботится о структуре и порядке в мире.

Всякий раз, когда мы ставим перед собой цели и стремимся улучшить свою жизнь, мы фактически идём против энтропии. Вот почему трудно придерживаться хороших привычек в долгосрочной перспективе и восстанавливаться после неудач.

Вот почему трудно придерживаться хороших привычек в долгосрочной перспективе и восстанавливаться после неудач.

Непрерывное совершенствование – это стремление постоянно расходовать энергию и бороться с потоком энтропии. Без усилий энтропия возрастает, жизнь усложняется, и всё рушится.

Или как сказал великий драматург Антон Чехов: «Только энтропия даётся легко».

http://muz4in.net/news/ehntropija_pochemu_zhizn_kazhetsja_takoj_slozhnoj/2020-06-04-51838

Ваша стабильность зависит от степени неопределенности, которую вы можете терпеть.

Единственная уверенность в жизни — это перемены. Но это единственная уверенность, которую мы отказываемся принимать. Нам слишком комфортно с тем, что мы знаем. Знакомое заставляет нас чувствовать себя в безопасности. Безопасный от невзгод.

Вот почему мы создаем пузыри, в которых и живем. Эти пузыри «безопасности» поддерживаются нашими привычками, образом мышления, убеждениями и ценностями. Они подтверждают наше видение мира и самих себя. Они дают нам ощущение постоянства и стабильности.

Они дают нам ощущение постоянства и стабильности.

Проблема в том, что эти пузыри не более твердые, чем мыльные пузыри. И душевное равновесие, которого мы в ней достигаем, может быстро уступить место психологической энтропии. Когда мир вокруг нас меняется и становится неопределенным, у нас есть две возможности: погрузиться в энтропию или вернуться с новым равновесием. Прямо сейчас мы проходим через глубокое состояние психологической и социальной энтропии.

Что такое психологическая энтропия?

Энтропия — это концепция, полученная из термодинамики, согласно которой системы стремятся к состоянию хаоса и беспорядка. В психологической сфере эта концепция описывает степень неопределенности и беспорядка, существующих в системе.

Карл Юнг, например, считал, что законы физического сохранения энергии применимы к нашей психике. Он сказал, что когда в одной из наших психологических функций наблюдается переизбыток энергии, это означает, что другая функция лишена ее, что порождает дисбаланс.

Однако он указал, что наш разум имеет тенденцию вводить механизмы компенсации, чтобы избежать полной энтропии и поддерживать определенную стабильность. Защитные механизмы являются примером этой попытки компенсации. Когда реальность становится неприемлемой, мы активируем барьер, защищающий наше эго и поддерживающий образ, который мы сформировали о себе.

Неопределенность как мера психологической энтропии

Одной из мер для оценки уровня беспорядка в системах, включая наш разум, является неопределенность — степень, в которой мы можем знать, как различные компоненты системы устроены в любой момент времени. данное время.

Например, в несмешанной колоде карт мы можем точно знать, как расположены карты. Если мы разрежем колоду и увидим туз червей, мы узнаем, что карта под ней — двойка червей. Однако, если мы перетасуем колоду, мы снизим эту уверенность до такой степени, что больше не сможем надежно предсказать, какая из оставшихся карт находится под этим червовым тузом. Полностью смешанная колода будет представлять собой полностью энтропийную систему.

Полностью смешанная колода будет представлять собой полностью энтропийную систему.

Все, что составляет нашу жизнь, похоже на эту колоду карт. Приятно быть уверенным, что наш партнер будет ждать нас дома. Иметь безопасную работу. Зная, что люди, которых мы любим, в порядке, точное время отправления автобуса или самолета…

Однако правила игры могут измениться в любой момент, как показала нам эта пандемия или как это происходит, когда мы переезжаем в другую страну . В таких случаях наших когнитивных моделей, ментальной карты мира, которую мы сформировали, недостаточно, чтобы предсказать, что произойдет.

В этот момент мы обычно впадаем в состояние максимальной ментальной энтропии. Внешний хаос дезорганизует наш внутренний мир. Поскольку у нас нет опоры, за которую можно было бы цепляться, мы становимся некритичными и рассматриваем все восприятия, от самого конкретного объекта до самой эфемерной иллюзии, как одинаково достоверные представления реальности. Когда у нас нет уверенности, все понятно и возможно.

Трансформирующая энтропия

Когда мы не в состоянии терпеть неопределенность, потому что она разрушает основы, на которых мы строили нашу повседневную жизнь, идеально построенный внутренний мир начинает разрушаться. Итак, у нас есть два варианта.

Первый из них — погрузиться в хаос и позволить царствовать энтропии, и в этом случае у нас, скорее всего, разовьются такие расстройства, как тревога, депрессия или даже психоз. Фактически, неспособность просмотреть интерпретативные структуры после травмы была предложена для объяснения развития посттравматического стрессового расстройства. Это расстройство было бы результатом нашей неспособности создать организованный рассказ о травме, который упорядочивает наш мир.

Вторая альтернатива — стремиться к снижению уровня энтропии до тех пор, пока мы не достигнем оптимальной точки равновесия, которая позволит нам терпеть неопределенность, в то же время развивая достаточно предсказуемое восприятие мира, чтобы позволить нам продолжать свою жизнь.

Мы должны помнить, что неопределенность всегда ставит перед нами серьезную адаптивную проблему, которая, теоретически, должна побуждать нас действовать, чтобы поддерживать ее на уровне, с которым мы можем справиться. Именно в эти моменты, по Юнгу, происходят самые преобразующие изменения в нашей жизни.

Этот психоаналитик полагал, что, когда мы сталкиваемся с важным событием, которое ставит под сомнение некоторые из наших самых устоявшихся предположений или убеждений, наше равновесие резко качается. В этот период для нас нормально чувствовать себя подавленными, тревожными или дезориентированными. Мы словно переживаем психологическое землетрясение.

После борьбы с этими новыми идеями, представлениями или тенями, наконец, формируется новое отношение, система убеждений, образ мышления или стиль выживания. Мы достигаем нового баланса, который обычно более обогащает, чем предыдущий. Любопытно, что эта новая формация будет тем прочнее, чем больше она будет отличаться от первоначальной позиции.

Принятие энтропии как части жизни

В жизни царят хаос и неопределенность, ничто не может быть на 100% предсказуемо и безопасно. Тем не менее, часто мы сопротивляемся принятию неопределенности. Это сопротивление только усугубит энтропию.

Сопротивляться переменам означает обрекать себя на постоянные страдания. На самом деле исследование, проведенное в Университете Торонто, показало, что наш мозг обрабатывает неопределенность так же, как тревогу. Это означает, что в долгосрочной перспективе это будет иметь для нас эмоциональный урон.

Одна из стратегий минимизации влияния неопределенности и защиты нашего психологического равновесия заключается в разработке гибких мысленных карт нашего окружения, которые помогут нам в хаосе достичь наших самых важных целей. Когда условия меняются, зацикленность на деталях приведет к пустой трате драгоценной энергии. Вместо этого мы должны быстро реорганизовать нашу карту ума, чтобы сосредоточиться на действительно важных целях в жизни. Так что у нас будет плацдарм посреди бури.

Так что у нас будет плацдарм посреди бури.

В любом случае, хотя нам всем нужна определенная степень когнитивной определенности и предсказуемости в нашей жизни, мы также должны признать, что являемся частью естественной и социальной среды, которая подвержена постоянным изменениям и имеет хаотичный и нестабильный компонент. Энтропия нам не враг, это еще одна особенность нашего разума, природы и мироздания.

Самоорганизующиеся системы, такие как мы, вовлечены в непрерывный диалог с окружающей средой и должны адаптироваться к изменяющимся обстоятельствам, чтобы поддерживать внутреннюю энтропию на управляемом уровне. То есть, если мы не в состоянии терпеть неопределенность мира, каждое изменение будет дестабилизировать нас психологически.

Как сказал Уильям Джеймс, наша внутренняя жизнь подвижна, беспокойна, непостоянна и всегда находится в движении. Эти переходы — реальность, мы живем в переходах, потому что все постоянно меняется.

Поэтому мы должны признать, что мы баланс и хаос. Стабильность и перемены. Предполагая, что эти изменения являются частью жизни и способствуют лучшему благополучию. Парадоксально, но чем больше мы принимаем хаос, тем ближе мы к безмятежности. Ключ в том, чтобы принять то, что мы не можем изменить, и трансформировать себя, чтобы лучше адаптироваться к каждому внешнему требованию.

Стабильность и перемены. Предполагая, что эти изменения являются частью жизни и способствуют лучшему благополучию. Парадоксально, но чем больше мы принимаем хаос, тем ближе мы к безмятежности. Ключ в том, чтобы принять то, что мы не можем изменить, и трансформировать себя, чтобы лучше адаптироваться к каждому внешнему требованию.

Источники:

Чжан, В. и Го, Б. (2017) Разрешение защитных механизмов: точка зрения, основанная на теории диссипативной структуры. Int J Психоанал; 98(2):457-472.

Хирш, Дж. Б. и др. Ал. (2012) Психологическая энтропия: основа для понимания тревоги, связанной с неопределенностью. Психолог преподобный; 119(2):304-20.

Юнг, К.Г. (1960) La estructura y dinámica de la psiquis, Vol. 8. Принстон: Издательство Принстонского университета.

Психологическая энтропия: основа для понимания тревоги, связанной с неопределенностью

. 2012 г., апрель; 119(2):304-20.

DOI: 10.1037/a0026767. Epub 2012 16 января.

Джейкоб Б Хирш 1 , Раймонд А. Мар, Джордан Б. Петерсон

принадлежность

- 1 Школа менеджмента Ротмана, Университет Торонто, Торонто, Онтарио, M5S3E6, Канада. [email protected]

- PMID: 22250757

- DOI: 10.1037/а0026767

Джейкоб Б. Хирш и др. Психолог преп. 2012 9 апр.0003

. 2012 г., апрель; 119(2):304-20.

2012 г., апрель; 119(2):304-20.

DOI: 10.1037/a0026767. Epub 2012 16 января.

Авторы

Джейкоб Б Хирш 1 , Раймонд А. Мар, Джордан Б. Петерсон

принадлежность

- 1 Школа менеджмента Ротмана, Университет Торонто, Торонто, Онтарио, M5S3E6, Канада. [email protected]

- PMID: 22250757

- DOI: 10.1037/а0026767

Абстрактный

Энтропия, концепция, полученная из термодинамики и теории информации, описывает степень неопределенности и беспорядка в системе.

Помещая обсуждение управления неопределенностью, фундаментальной биологической необходимости, в рамки теории информации и самоорганизующихся систем, наша модель помогает поместить ключевые психологические процессы в более широкий физический, концептуальный и эволюционный контекст.

Помещая обсуждение управления неопределенностью, фундаментальной биологической необходимости, в рамки теории информации и самоорганизующихся систем, наша модель помогает поместить ключевые психологические процессы в более широкий физический, концептуальный и эволюционный контекст.

Похожие статьи

-

Текущие теоретические модели генерализованного тревожного расстройства (ГТР): концептуальный обзор и последствия лечения.

Бехар Э., ДиМарко И.Д., Хеклер Э.Б., Молман Дж., Стейплз А.М. Бехар Э. и др. J Тревожное расстройство. 2009 дек; 23(8):1011-23. doi: 10.1016/j.janxdis.2009.07.006. Epub 2009 8 июля. J Тревожное расстройство. 2009. PMID: 19700258 Обзор.

-

Модель избегания страха хронической боли: следующее поколение.

Кромбез Г., Экклстон С., Ван Дамм С., Влайен Дж. В., Кароли П. Кромбез Г. и соавт. Клин Джей Пейн. 2012 июль; 28 (6): 475-83. дои: 10.1097/AJP.0b013e3182385392. Клин Джей Пейн. 2012. PMID: 22673479 Обзор.

-

Математическая основа для вероятностного выбора, основанная на теории информации и психофизике.

Такахаши Т. Такахаши Т. Мед Гипотезы. 2006;67(1):183-6. doi: 10.1016/j.mehy.2005.12.045. Epub 2006 3 марта. Мед Гипотезы. 2006. PMID: 16516404

-

Преодоление дилеммы взаимозависимости: цели привязанности и использование общих норм с потенциальными близкими людьми.

Барц Дж. А., Лайдон Дж. Э. Барц Дж.А. и соавт. J Pers Soc Psychol. 2006 г., июль; 91 (1): 77–96.

дои: 10.1037/0022-3514.91.1.77.

J Pers Soc Psychol. 2006.

PMID: 16834481

дои: 10.1037/0022-3514.91.1.77.

J Pers Soc Psychol. 2006.

PMID: 16834481 -

Снижение тревожности посредством отстранения: субъективные, физиологические и нервные эффекты.

Калиш Р., Вич К., Кричли Х.Д., Сеймур Б., О’Доэрти Дж.П., Окли Д.А., Аллен П., Долан Р.Дж. Калиш Р. и соавт. J Cogn Neurosci. 2005 июнь; 17 (6): 874-83. дои: 10.1162/0898929054021184. J Cogn Neurosci. 2005. PMID: 15969906 Клиническое испытание.

Посмотреть все похожие статьи

термины MeSH

вещества

Введение в энтропию для нейробиологов и психологов

Энтропия — одно из самых полезных понятий в науке, но также и одно из самых запутанных. Эта статья служит кратким введением в различные типы энтропии, которые можно использовать для количественной оценки свойств динамических систем, включая человеческий мозг. Во-первых, необходимо понять историю и эволюцию термина.

Эта статья служит кратким введением в различные типы энтропии, которые можно использовать для количественной оценки свойств динамических систем, включая человеческий мозг. Во-первых, необходимо понять историю и эволюцию термина.

Концепция энтропии, обычно понимаемая как «беспорядок», была разработана в 19 веке Сади Карно и Рудольфом Клаузиусом, которые искали наиболее эффективный способ преобразования энергии теплового потока в механическую энергию, которая могла бы приводить в действие машины. Паровая машина существовала уже некоторое время и была доказательством того, что энергию можно извлекать из теплового потока для выполнения физической работы.

Карно заметил, что если существует разница температур — или «градиент» — между двумя соприкасающимися телами, теплота будет спонтанно перетекать от более горячего тела к более холодному до тех пор, пока оба не достигнут взаимной однородной температуры, состояние, известное как « термодинамическое равновесие». Мы сталкиваемся с этим явлением всякий раз, когда наша теплая чашка кофе взаимодействует с окружающим воздухом и охлаждается до комнатной температуры. Когда у вас есть температурный градиент, поток тепла, который возникает, чтобы устранить градиент, создает физическую силу, которую можно использовать для выполнения работы. Но Карно понимал, что преобразование тепловой энергии в механическую — это процесс, эффективность которого никогда не может быть стопроцентной — часть полезной энергии всегда будет уходить в окружающую среду из-за того, что физики называют «9».0069 диссипация .

Когда у вас есть температурный градиент, поток тепла, который возникает, чтобы устранить градиент, создает физическую силу, которую можно использовать для выполнения работы. Но Карно понимал, что преобразование тепловой энергии в механическую — это процесс, эффективность которого никогда не может быть стопроцентной — часть полезной энергии всегда будет уходить в окружающую среду из-за того, что физики называют «9».0069 диссипация .

Рассеивание энергии просто означает, что она равномерно рассеивается в окружающей среде, рассеивается таким образом, что ее больше нельзя использовать для выполнения работы. Знакомый пример рассеивания энергии — тепло тела, которое мы, люди — сложные адаптивные системы — постоянно выделяем. Другим является тепло, выделяемое вашим портативным компьютером во время вычислений. Качающийся маятник в напольных часах постоянно рассеивает небольшое количество энергии из-за постоянного трения с воздухом, поэтому в конце концов он должен остановиться. Каждый механический процесс, происходящий во Вселенной, рассеивает некоторое количество полезной энергии, выделяя тепло. Это основа знаменитого «второго закона термодинамики». Энтропия — в первоначальном понимании — это математический термин, обозначающий количество энергии больше недоступное для работы . Поскольку существует более одного типа энтропии, мы будем называть этот вид тепловой энтропией .

Это основа знаменитого «второго закона термодинамики». Энтропия — в первоначальном понимании — это математический термин, обозначающий количество энергии больше недоступное для работы . Поскольку существует более одного типа энтропии, мы будем называть этот вид тепловой энтропией .

Как видите, до сих пор не было ни слова о порядке или беспорядке. Откуда же взялось это популярное представление об энтропии как о беспорядке?

Во второй половине 19 века поддержка атомной теории быстро росла, и физики начали искать микромасштабные объяснения для всех ранее объясненных явлений, поскольку они считались более фундаментальными. Австрийский физик Людвиг Больцман попытался объяснить второй закон, а именно тенденцию тепловой энергии рассеиваться и рассеиваться, как результат статистического поведения огромного числа молекул, движущихся в соответствии с простыми законами механики. Больцмана вдохновило на микроскопическое мышление недавнее открытие, что кинетическая энергия газа является прямым следствием того, насколько быстро движутся его отдельные молекулы.

Больцман рассудил, что если кинетическая энергия представляет собой не что иное, как увеличение молекулярного движения, то ее диссипация должна сопровождаться постепенной диффузией и затуханием этого возбужденного движения с течением времени, что, как он подозревал, может быть связано со случайными столкновениями между молекулами. Чтобы исследовать эту модель рассеивания энергии — или создания энтропии, поскольку это две стороны одной медали, — он мудро выбрал простую систему: идеальный газ в закрытом сосуде.

Больцман представил себе группу молекул, быстро мчащихся во всех направлениях, часто натыкающихся друг на друга, как бильярдные шары на бильярдном столе, передающих импульс и распространяющих друг друга в пространстве. Когда молекулы случайным образом сталкиваются, более быстрые, естественно, замедляются, а более медленные ускоряются, пока, в конце концов, скорость всех не станет примерно одинаковой. Без каких-либо энергетических различий между молекулами не существует температурных градиентов и, следовательно, тепловых потоков, которые можно использовать для выполнения работы. Согласно этому объяснению, изолированная система неизбежно приблизится к термодинамическому равновесию из-за эффектов бесчисленных невидимых молекулярных взаимодействий.

Согласно этому объяснению, изолированная система неизбежно приблизится к термодинамическому равновесию из-за эффектов бесчисленных невидимых молекулярных взаимодействий.

Больцман описал систему, приближающуюся к термодинамическому равновесию, как становящуюся более «беспорядочной», потому что независимо от того, как частицы в системе были расположены изначально — возможно, более быстрые молекулы были аккуратно сгруппированы в одном углу контейнера — коллективная конфигурация неизбежно дрейфовать к однородному пространственному распределению, лишенному каких-либо шаблонов или различимой структуры. По этой причине Больцман считал это состояние термодинамического равновесия и максимальной энтропии состоянием «максимального беспорядка».

Причина, по которой изолированные системы естественным образом смещаются в сторону более высокой энтропии или беспорядка, заключается в том, что существует гораздо больше способов быть запутанными и беспорядочными, чем способов быть организованными и структурированными. Системы естественным образом дрейфуют в сторону беспорядка из-за масштабных эффектов случайности.

Системы естественным образом дрейфуют в сторону беспорядка из-за масштабных эффектов случайности.

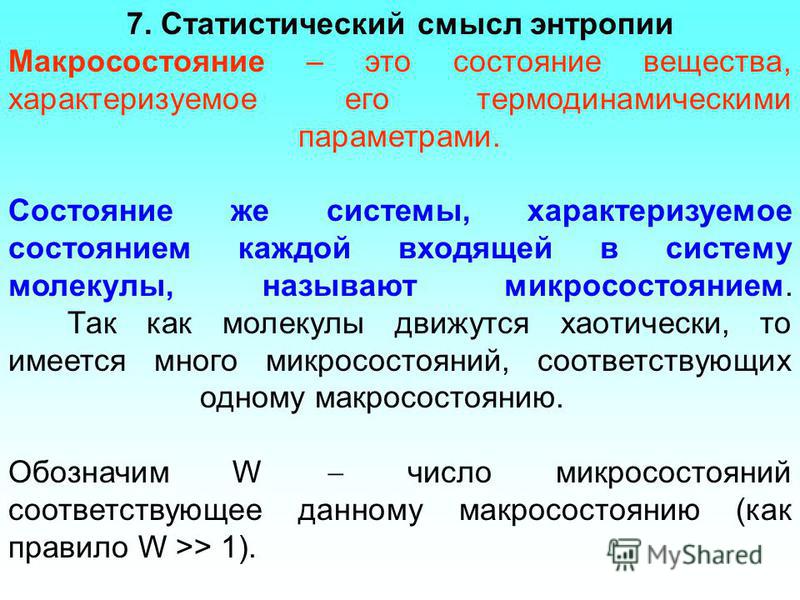

Хотя на первый взгляд это не очевидно, эта концепция энтропии, известная как статистическая энтропия , позволяет нам думать о беспорядке с точки зрения информации, и при этом мы видим, что энтропия любопытным образом связана со знанием наблюдателя и их незнание точного физического состояния наблюдаемой системы. Чтобы понять, как энтропия может быть мерой невежества или неуверенности, мы должны понимать различие микросостояний и макросостояний.

Макросостояние представляет собой коллективное свойство системы многих частиц и может быть легко измерено, как средняя температура системы молекул газа (глобальная мера), тогда как микросостояние является подробным описанием положения и скорость каждой молекулы в системе, которую оказывается невозможно измерить из-за квантовой неопределенности и хаоса классического масштаба.

Для любой динамической системы существует множество различных микросостояний, соответствующих одному макросостоянию. Это связано с тем, что существует множество эквивалентных способов распределения отдельных молекул, которые имеют одинаковую общую кинетическую энергию. Больцман показал, что энтропия — это мера того, сколько различных способов может быть организовано в системе без изменения ее макросостояния. Чем выше энтропия, тем больше микросостояний соответствует одному макросостоянию, потому что существует гораздо больше способов упорядочить беспорядочный беспорядок.

Это связано с тем, что существует множество эквивалентных способов распределения отдельных молекул, которые имеют одинаковую общую кинетическую энергию. Больцман показал, что энтропия — это мера того, сколько различных способов может быть организовано в системе без изменения ее макросостояния. Чем выше энтропия, тем больше микросостояний соответствует одному макросостоянию, потому что существует гораздо больше способов упорядочить беспорядочный беспорядок.

В 1960-х годах физик Э.Т. Джейнс показал, что больцмановская энтропия — это не просто мера беспорядка или количество микросостояний, соответствующих определенному макросостоянию. Энтропия также является мерой неопределенности или невежества наблюдателя, наблюдающего за макросостоянием системы и не знающего конкретное микросостояние. Поскольку состояния с более высоким беспорядком имеют более эквивалентные микросостояния, соответствующие уникальному макросостоянию, более высокая энтропия означает большее незнание — или меньшую уверенность — в отношении конкретного микросостояния, в котором находится система. системы, потому что больше узнаётся (получается больше битов информации), когда есть больше альтернативных возможностей, которые устраняются актом наблюдения.

системы, потому что больше узнаётся (получается больше битов информации), когда есть больше альтернативных возможностей, которые устраняются актом наблюдения.

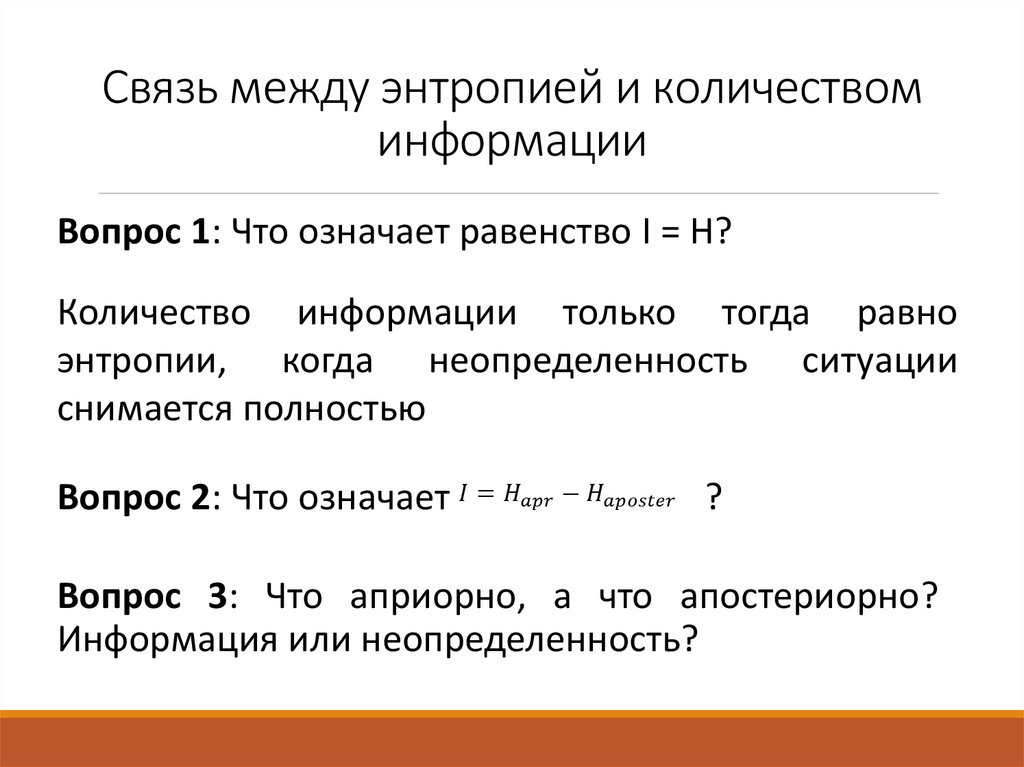

Вот почему статистическая термодинамика и теория информации Клода Шеннона по сути являются одной и той же теорией: энтропия Шеннона, называемая информационной энтропией , является мерой того, в скольких состояниях может находиться система или сколько альтернативных сообщений может быть отправлено по каналу связи. канал. Согласно теории Шеннона, информация — это «уменьшение неопределенности», а количество информации в сигнале соответствует количеству неопределенности или незнания, которое было уменьшено при получении сообщения.

Давайте подумаем об информации, получаемой при подбрасывании монеты и наблюдении за результатом. Перед подбрасыванием монеты никто не знает, выпадет ли она орлом или решкой, а при честной монете шансы составляют 50 на 50. Когда он приземляется, и вы смотрите на результат, вы сворачиваете два вероятных состояния в одно четко определенное и при этом получаете ровно один бит информации.

Теперь вместо монеты, которая имеет только два возможных состояния, представьте, что вы бросаете шестигранный кубик с закрытыми глазами. В этом примере ваша неопределенность больше, потому что существует больше состояний, в которых потенциально может находиться игральная кость. Когда вы открываете глаза и наблюдаете, как она приземлилась, вы уменьшаете неопределенность и, следовательно, получаете больше битов информации. Количество полученной информации пропорционально количеству возможных альтернатив.

Поскольку энтропия может быть мерой количества состояний, в которых может находиться система, или количества способов ее настройки, энтропийные меры можно использовать для измерения сложности сложной адаптивной системы.

Например, можно обоснованно предположить, что интеллект вида соответствует количеству доступных состояний в его поведенческом или ментальном репертуаре. Чтобы количественно определить это число, мы можем описать его с точки зрения энтропии: чем больше возможных состояний может быть у когнитивной системы, тем выше энтропия. В этом приложении энтропия является не столько мерой беспорядка, сколько мерой пропускной способности канала или когнитивной пропускной способности. Это также мера нашего незнания точного внутреннего или психического состояния организма в данный момент времени, если мы не можем непосредственно наблюдать за состоянием организма.

В этом приложении энтропия является не столько мерой беспорядка, сколько мерой пропускной способности канала или когнитивной пропускной способности. Это также мера нашего незнания точного внутреннего или психического состояния организма в данный момент времени, если мы не можем непосредственно наблюдать за состоянием организма.

Нейробиолог Робин Кархарт-Харрис из Имперского колледжа Лондона, чья «Гипотеза энтропии мозга» пытается объяснить влияние психоделиков на состояния сознания, цитирует «фи» Интегрированной теории информации как меру информационной энтропии для мозга:

«Принятая здесь точка зрения состоит в том, что человеческий мозг обладает большей энтропией, чем другие представители животного мира, что равносильно утверждению, что человеческий разум обладает большим набором потенциальных психических состояний, чем низшие животные».

В этой вводной статье описаны только самые основные типы энтропии. Краткое изложение различных мер энтропии, используемых в науках о мозге, таких как перенос, дифференциальная, перестановочная или многомасштабная энтропия, см.