Компьютерная презентация на тему язык тела: «Язык телодвижений Как читать мысли окружающих по их жестам. Из серии «Психология успеха»». Скачать бесплатно и без регистрации.

Презентация Язык телодвижений

Название: Язык телодвижений (презентация)

Автор: Баимова Раушания Калитаевна

Год: 2009

Страниц: 24

Формат: презентация в формате ppt (rar архив)

Размер: 11,7 Мб

Качество: хорошее

Презентация по мотивам книг Аллана и Барбары Пиз “Язык телодвижений” и “Новый язык телодвижений” может быть использована для проведения тренингов общения, классных часов, а так же на уроках психологии.

Люди часто говорят совсем не то, что думают и чувствуют на самом деле.

Язык тела несет в себе массу информации.

В представленной работе мы предлагаем рассмотреть значения некоторых жестов и мимики.

Содержание:

- Общее представление

- Территории и зоны

- Жесты рук

- Сигналы глаз

- Заключение

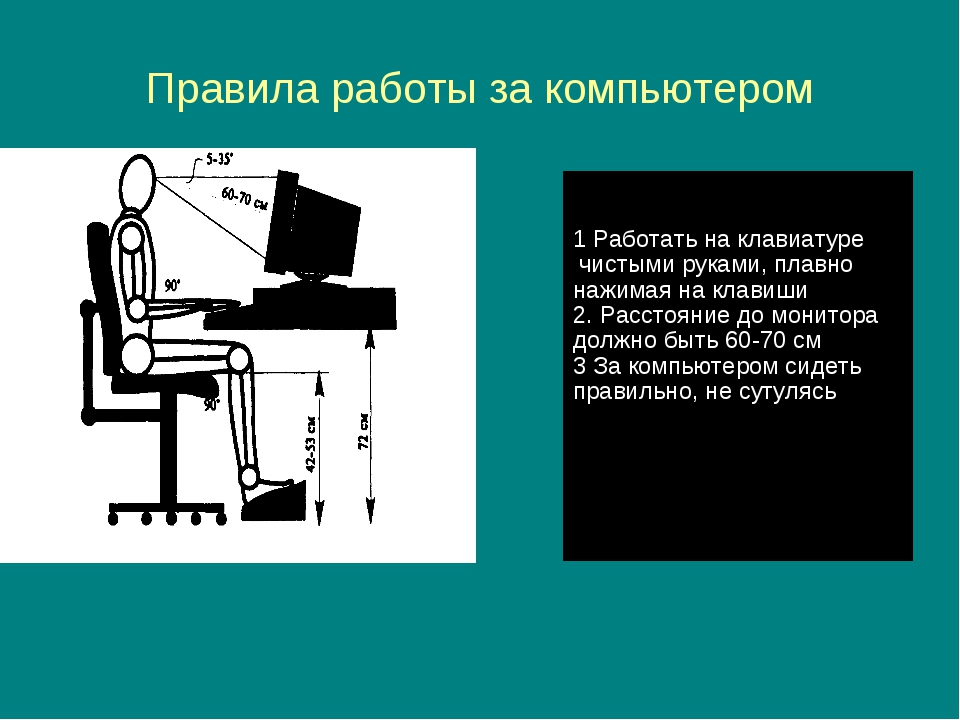

Общее представление:

Человеческое общение на 7 % является вербальным (слова и фразы), на 38 % вокальным (интонация, тон голоса, др. звуки), на 55 % – невербальным.

звуки), на 55 % – невербальным.

Вербальные способы используются для передачи фактической информации, а невербально передаются эмоции и чувства собеседников.

Язык тела состоит из слов, предложений и знаков препинания. Каждый жест – это слово, а слово может иметь множество различных значений. Только поставив слово в предложение и окружив его другими словами можно понять точно его значение

Жесты собираются в «предложения», поняв их смысл вы безошибочно сможете понять истинные чувства собеседника и его отношение к вам

Скачать презентацию “Язык телодвижений”

с Depositfiles

СКАЧАТЬ

Скачать презентацию “Язык телодвижений”

с Narod.Yandex.ru

[restrict userlevel=”subscriber”]СКАЧАТЬ [/restrict]

На ту же тему:

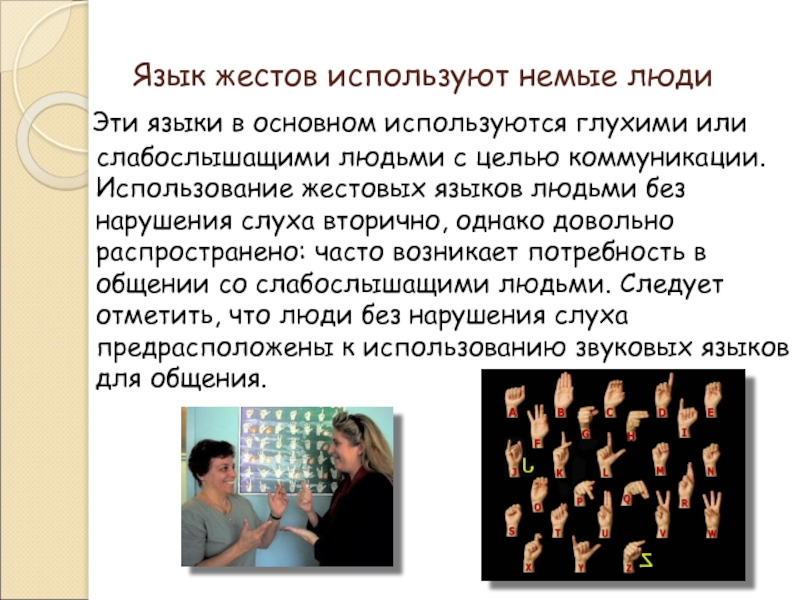

«НЕПРИЗНАННЫЙ ЯЗЫК» (ЯЗЫК ЖЕСТОВ ГЛУХИХ И КОМПЬЮТЕРНАЯ ЛИНГВИСТИКА)

«НЕПРИЗНАННЫЙ ЯЗЫК» (ЯЗЫК ЖЕСТОВ ГЛУХИХ И КОМПЬЮТЕРНАЯ ЛИНГВИСТИКА)

А. Л. Воскресенский

Л. Воскресенский

Специализированная (коррекционная) общеобразовательная

школа-интернат № 101 для детей с нарушениями слуха

Ключевые слова: компьютерная анимация, глухие, диалог, перевод, словарь, сурдоперевод , язык жестов.

В докладе внимание лингвистов и ИТ специалистов обращается на жестовый язык глухих. Приводятся данные о распространенности этого языка, его официальном статусе. Указывается, что возможность фиксации и многократной демонстрации динамически меняющихся во времени и пространстве жестов (т.е. письменность) жестовый язык приобрел фактически только при появлении мультимедийных средств. Показано, что создание средств автоматизированного сурдоперевода требует решения и/или использования результатов решения основных задач компьютерной лингвистики: организации ЕЯ-запросов к полнотекстовым базам данных для различных предметных областей, речевой ввод и вывод, генерация связного текста на основе ключевых слов и выражений, автоматический разбор текста с целью выделения значащих слов.

- Жестовый язык глухих: распространенность и статус

Есть язык, который обойден вниманием лингвистов (и не только их), но которым пользуются миллионы людей — язык жестов глухих. В среднем в мире число полностью глухих составляет 0,4% от общей численности населения, а учитывая людей с тяжелыми формами потери слуха, число тех, кто постоянно пользуется жестовым языком, достигает примерно 1,5% от общей численности населения. Например, в США по данным ASLTA (Ассоциация преподавателей американского жестового языка) американский жестовый язык (ASL) — третий по распространенности после английского и испанского.

Официальное признание жестовый язык начал получать лишь недавно. Отношение к нему в разных странах со стороны официальных органов (в том числе и образования) до недавнего времени колебалось от игнорирования его существования до активного запрета в использовании, например в образовательных учреждениях для глухих. Это объяснялось необходимостью стимулирования изучения и использования глухими средств коммуникации со слышащими: слухо-зрительного восприятия речи, формирования произношения и развития речи для лучшей адаптации в мире слышащих.

Но постепенно, по мере изменения отношения общества к инвалидам, эта позиция менялась. В Резолюции ООН 48/96 указано: “Следует использовать жестовый язык в образовании глухих детей, в их семьях и сообществе глухих. Для облегчения понимания между глухими и окружающими следует оказывать переводческие услуги на жестовом языке” [1].

В нашей стране русский жестовый язык (РЖЯ) сравнительно недавно официально признан языком межличностного общения [2]. Этот статус ниже, чем статус национального языка, и, возможно, этим объясняется, что, в то время как для изучения языков малых народов организуются научные экспедиции, жестовый язык, которым в России пользуются (по нашим оценкам) не менее 2 млн. человек, не имеет даже достаточно полного описания грамматики.

Зарплата сурдопереводчика ниже, чем зарплата переводчика-синхрониста иностранного языка. Соответственно, низок и престиж профессии. Одним из результатов этого явилось то, что конкурс по набору сурдопереводчиков для телеканала ОРТ в 2001 г. показал отсутствие таких специалистов [3].

показал отсутствие таких специалистов [3].

Повышение статуса жестового языка глухие рассматривают как одно из направлений борьбы за свои гражданские права. В настоящее время готовятся предложения о повышении статуса жестового языка, о признании права глухих граждан пользоваться РЖЯ во всех областях социальной жизни, по созданию Государственной программы развития лингвистических, социологических и других исследований РЖЯ [4].

- Мультимедийные средства как основа “письменности” жестового языка

Первые попытки описания жестового языка делались в Европе уже в 17 веке [5]. В России первой книгой об обучении глухих, о русском жестовом языке была [6]. Однако сложность представления с помощью статичных двумерных книжных иллюстраций динамически меняющихся во времени и пространстве жестов оказалась препятствием для создания научного описания РЖЯ. Если в иероглифах (которым, с определенной степенью допущения, можно уподобить жесты), например, японского языка выделяются ключевые элементы, на основании которых строятся словари [7], то в жестах выделения подобных ключевых элементов (или  Работы В. Стоку, выполненные в США в 60-е годы XX века, показали, что жест состоит из трех основных компонентов: конфигурации,пространственного положения и движения [8].

Работы В. Стоку, выполненные в США в 60-е годы XX века, показали, что жест состоит из трех основных компонентов: конфигурации,пространственного положения и движения [8].

Бумажные словари (см., например [9]), при всей их полезности, не могут отразить все особенности выполнения отдельных жестов и помочь в составлении фраз на РЖЯ. Появление мультимедийных средств дало возможность, используя технику видеозаписи, создавать обучающие курсы жестового языка, в которые включаются уже не только отдельные понятия (жесты), но и образцы фраз и диалогов [5].

Таким образом, только с появлением видеотехники и мультимедийных компьютеров жестовый язык получил возможность записи ТЕКСТА, т.е. обрел письменность и, соответственно, возможность фиксации и многократного воспроизведения жестовых высказываний, анализа и углубленного изучения их грамматических и других особенностей.

Однако, жестовые словари, выполненные в виде упорядоченных видеофрагментов, представляющих как отдельные жесты жестового языка, так и их различные комбинации: образцы фраз, диалоги, другие тексты, записанные с помощью демонстраторов (лиц, знающих жестовый язык), имеют тот недостаток, что они могут пополняться только с помощью тех же демонстраторов жестов, которые работали над их первой версией. Такие словари, в отличие от, например, словаря русского языка Ожегова, который продолжал развиваться силами соавторов даже после смерти первого автора, имеют ограниченную возможность развития.

Такие словари, в отличие от, например, словаря русского языка Ожегова, который продолжал развиваться силами соавторов даже после смерти первого автора, имеют ограниченную возможность развития.

Это утверждение основано на том, что у многих глухих детей, которые нуждаются в изучении и усвоении жестового языка, отсутствие речевой практики, сопровождающей слышащих детей с самого рождения (даже еще не умея говорить, они уже учатся понимать речь), приводит к замедлению развития словесно-логического уровня мышления. При этом мышление на наглядно-образном уровне у них обычно развито вполне удовлетворительно. Вследствие этого мышление у многих глухих весьма конкретно, абстрагирование от того или иного образа к некоему собирательному понятию вызывает у них определенные затруднения. У них в ряде случаев вызывает отторжение наделение каких-либо персонажей несвойственными им в реальной жизни атрибутами, что для слышащих детей вполне приемлемо и допустимо. Так, например, разработчики американского CD-ROM [10] столкнулись с тем, что у американских глухих детей резкое неприятие вызвало предложение выбрать в качестве виртуального демонстратора жестов одного из популярных героев мультфильмов — лягушонка Роско.

Таким образом, использование в качестве демонстраторов жестов в пределах одного словаря (или одного текста) разных лиц с высокой степенью вероятности приведет к дополнительным затруднениям для глухого пользователя в работе с этим словарем или жестовым текстом. Поэтому наиболее целесообразно для демонстрации жестов использовать не фрагменты видеозаписи реальных жестикулирующих людей, а программно генерируемые мультипликационные изображения виртуальных персонажей. Существующие пакеты для компьютерной анимации позволяют обеспечить пользователю выбор наиболее приемлемого для него варианта облика (skin) персонажа.

В то же время, проведенные в 1999-2000 гг. Ю.А. Петропавловской эксперименты показали, что использование в качестве виртуального демонстратора жестов абстрактного (упрощенного) изображения человека вызывает у учащихся московской школы для глухих детей вопросы: “Кто это? Это мужчина или женщина?”.

Использование средств компьютерной анимации позволяет не только программно компоновать соответствующий жест в режиме реального времени, но и учитывать при этом предшествующее положение рук, головы и туловища персонажа (а также соответствующую мимику), что позволяет формировать запись “связного текста” жестовой речи произвольной длительности.

Использование компьютерной анимации и результатов описанных выше экспериментов позволило создать прототип многоязычного словаря жестового языка [11, 12]. В нем объединены русско-английский и англо-русский словари.

В нем объединены русско-английский и англо-русский словари.

- Методы компьютерной лингвистики при изучении и использовании жестового языка

3.1. Нужны ли компьютерные средства представления и обработки жестового языка?

Считается, что все глухие (за исключением малых детей) грамотны, и на этом основании задается вопрос: зачем нужны средства представления и обработки жестового языка, почему недостаточно текстовых титров, например, в телевизионных новостях и других передачах? Да, замена сурдопереводчиков на ОРТ текстовыми титрами вызвала положительный отклик у многих глухих. Они не понимали многих жестов, демонстрируемых сурдопереводчиками, т.к. отсутствие нормализованного описания жестового языка и соответствующих учебных пособий приводит к тому, что язык распадается на множество диалектов, которые без дополнительного, хотя бы краткого изучения, лишь частично понятны носителям других диалектов.

Однако, использование только текстовых сообщений и подсказок недостаточно в процессе обучения глухих и слабослышащих учащихся. Для лучшего усвоения материала и ускорения процесса обучения необходимы как специальные технические средства [13], так и сурдопереводчики. При этом, по мере повышения уровня образования и владения речью, глухие постепенно отказываются от услуг сурдопереводчиков (например, по наблюдениям Г.Н. Паршина, слабослышащие студенты МГТУ им. Н. Баумана к третьему курсу практически полностью отказываются от сурдоперевода), но продолжают пользоваться жестовой речью в общении друг с другом.

Почему грамотные слышащие в повседневном общении обмениваются устными сообщениями, а не записками? Ответ очевиден. Жестовая речь заменяет для глухих устную, но, в отличие от слышащих, для которых процесс обучения устной речи происходит практически автоматически в процессе общения с окружающими, усвоение жестовой речи требует от глухих более напряженного процесса обучения. Нередки случаи рождения глухих детей в семьях слышащих родителей, не знакомых с жестовой речью. Для использования жестового языка даже только в качестве средства межличностного общения нужно его знать. А для этого нужны учебные курсы и пособия, для создания которых необходимо использование компьютерных технологий.

Для использования жестового языка даже только в качестве средства межличностного общения нужно его знать. А для этого нужны учебные курсы и пособия, для создания которых необходимо использование компьютерных технологий.

3.2. Некоторые особенности жестовой речи

Жестовая речь имеет две различные речевые системы [8]: РЖЯ, используемый в повседневном общении, обладающий собственной лексикой и грамматикой и калькирующая жестовая речь (КЖР), используемая в официальной обстановке, в которой жесты сопровождают устную речь говорящего. Жесты в КЖР выступают как эквиваленты слов, а порядок их следования такой же, как и слов в соответствующем предложении. КЖР использует жесты РЖЯ и знаки дактильного алфавита для побуквенной передачи слов, для которых нет жестового эквивалента. (Русская дактильная азбука, а также некоторые другие дактильные алфавиты представлены в [14]).

Число жестов РЖЯ значительно меньше числа слов русского языка. При этом одним и тем же жестом могут обозначаться разные денотаты [8].

При этом одним и тем же жестом могут обозначаться разные денотаты [8].

В РЖЯ нет изменения существительных по падежам, глаголы имеют только одну форму — инфинитив. Для обозначения времени действия используются служебные жесты “было” (“не было”), “будет”, “давно”.

Диалоги на РЖЯ представляют собой обычно обмен отрывочными сообщениями, причем первое высказывание инициатора беседы задает тему, а последующие высказывания участников диалога развивают и уточняют первоначальную мысль. Поэтому новому участнику диалога (не знакомому с высказываниями, открывшими данную часть диалога) иногда бывает трудно понять собеседников. Для включения его в беседу в этом случае приходится заново излагать основную тему.

Также как и при обычных бытовых диалогах, в высказываниях на РЖЯ зачастую опускаются глаголы, вся фраза значительно редуцируется, приобретая иногда мало узнаваемый вид по сравнению со своим аналогом на рафинированном литературном языке (ср. , например, wonna, gotta в разговорном английском языке).

, например, wonna, gotta в разговорном английском языке).

Жестовые высказывания обладают весьма сильно выраженной конситуативностью: в жестовых языках нет специальных жестов для обозначения того, “что всегда присутствует в разговоре”, например головы, руки, носа и т.п. [8]. Эти значения выражаются указанием, например, на свою руку. Нужно отметить, что конситуативность жестовой речи облегчает общение глухих из разных стран. При встрече с учащимися из Англии учащиеся нашей школы практически сразу же смогли вести с ними беседы на различные темы при помощи жестовой речи, несмотря на то, что англичане не знали русского языка, а наши учащиеся не были знакомы с британским жестовым языком.

Как указывается в [8], для пояснения причинно-следственных связей в высказывания на РЖЯ включаются служебные жесты “связь”, но в реальных диалогах подобные жесты обычно отсутствуют. Хотя здесь нужно сделать оговорку, что набор используемых жестов во многом зависит от уровня образованности и возраста участников диалогов.

Также как и слышащие, глухие подростки имеют свой молодежный жаргон. К 14 – 15 годам число используемых жестов РЖЯ достигает обычно максимума, в дальнейшем число используемых жестов (и в ряде случаев, к сожалению, число используемых слов русского языка) несколько уменьшается, а их набор стабилизируется.

3.3. Основные проблемы сурдоперевода и сопутствующие задачи компьютерной лингвистики

Как правило, проблемы возникают при переводе на менее знакомый для переводчика язык (обычно тот язык, носителем которого он не является). В случае с РЖЯ ситуация противоположная: наибольшую сложность вызывает перевод с РЖЯ на русский язык [3], хотя сурдопереводчиками обычно бывают слышащие люди, русский язык для которых является родным. Это можно объяснить тем, что, в связи со значительной редукцией фраз на РЖЯ, сурдопереводчику нужно в ограниченное время построить на основе отдельных, малосвязанных слов, переданных ему жестами, грамотную фразу на русском языке, достаточно полно передающую смысл жестового высказывания, соответствующий данной предметной области.

Таким образом, одной из важнейших задач компьютерной лингвистики в области сурдоперевода является генерация связного текста на основе ключевых слов и выражений, полученных из “подстрочного перевода” жестового высказывания. Учитывая многозначность жестов, необходимо тщательно отслеживать соответствие генерируемого текста текущей предметной области. Это весьма сложная задача, эквивалентная созданию автоматических диалоговых систем на основе организации запросов на естественном языке к полнотекстовым базам данных для различных предметных областей. Появление таких систем дает некоторую надежду на возможность реализации описываемой задачи, что даст слышащим дополнительные возможности понимания своих глухих собратьев.

Но и перевод с русского языка на РЖЯ создает немало проблем. Обычно, с ростом уровня образованности глухой аудитории возрастает число используемых жестов, структура высказываний приближается к нормам русского языка, т.е. место РЖЯ занимает КЖР, где каждому слову (или устойчивой комбинации слов) соответствует свой жест, а последовательность жестов соответствует последовательности слов во фразе. Но при работе с РЖЯ во многих случаях перед началом демонстрации жестов приходится, по словам одного из сурдопереводчиков, предварительно переводить фразу с русского на “глуховский” язык, создавая нужную последовательность жестов.

Но при работе с РЖЯ во многих случаях перед началом демонстрации жестов приходится, по словам одного из сурдопереводчиков, предварительно переводить фразу с русского на “глуховский” язык, создавая нужную последовательность жестов.

Исходя из этого, система перевода с русского языка на РЖЯ должна уметь привести фразу на русском языке к виду запроса, обеспечивающего выдачу из базы данных требуемой последовательности анимированных изображений жестов. При формировании этого запроса следует учитывать использование служебных жестов для передачи временных и пространственных отношений объектов, т.е. необходимо создание специализированного парсера, учитывающего особенности грамматики РЖЯ. К сожалению, автор до сих пор не встретил ни одной публикации, где приводилось бы достаточно полное описание этой грамматики.

Очевидно, что на завершающих этапах создания системы автоматизированного сурдоперевода возникнет необходимость подключения к ней подсистем речевого ввода и вывода, без чего функциональность системы будет неполной.

Система перевода с РЖЯ на русский язык не может считаться функционально полной без подсистемы оптического распознавания жестов. По сравнению с OCR эта задача на порядок (если не более) сложнее из-за многомерности и динамики жеста. Некоторые обнадеживающие результаты в этом направлении получены в INT (Франция) в рамках проекта Artemis [15].

Любое здание должно иметь фундамент. В описываемой задаче таким фундаментом, по нашему мнению, должны быть удобные в пользовании мультимедийные средства отображения жестов, не требующие больших затрат ресурсов при передаче по телекоммуникационным каналам. На основе этих средств планируется создание мультимедиа архива русского жестового языка, представленного в сети Интернет, основными функциями которого будут: создание и поддержка попопняемого словаря жестов и фраз; обеспечение преемственности работы по фиксации новых жестов; работа по нормализации жестового языка и описание грамматики русского жестового языка. Результаты этих работ в дальнейшем смогут быть использованы при создании систем автоматического сурдоперевода.

Автор благодарит руководителя слухового центра Е.В. Воробьеву и других сотрудников школы-интерната № 101 за объяснения многих неизвестных ему ранее явлений, полезные советы и рекомендации.

- Стандартные правила обеспечения равных возможностей инвалидов // Резолюция ООН 48/96. Раздел II, правило 5, статья 7. — ООН, 20 декабря 1993 г.

- О социальной защите инвалидов в Российской Федерации // Федеральный Закон № 181-ФЗ от 24.11.1995 г.

- Овсянникова Л.А. Проблемы жестового перевода на телевидении // Русский жестовый язык и проблемы перевода: Материалы конференции. — М., 2001.

- Резолюция конференции “Русский жестовый язык и проблемы перевода” // Русский жестовый язык и проблемы перевода: Материалы конференции. — М., 2001.

- Гуленков Г.А. Электронная обучающая система “Русский жестовый язык” // XI Международная конференция-выставка “Информационные технологии в образовании”: Материалы конференции. Ч. V. — М.: МИФИ, 2001.

С. 10 – 12.

С. 10 – 12. - Флери В.И. Глухонемые, рассматриваемые в отношении к способам образования, самым свойственным их природе. — СПб., 1835.

- Шевенко С.М. Пособие по переводу японских научно-технических текстов. Начальный курс. — М.: Главная редакция восточной литературы издательства “Наука”, 1973.

- Зайцева Г.Л. Дактилология. Жестовая речь: Учебное пособие для ВУЗов. — М.: Просвещение, 1991.

- Фрадкина Р.Н. Говорящие руки: Тематический словарь жестового языка глухих России. — М., 2001.

- http://signingavatar.com

- Воскресенский А.Л., Иванова М.В. Представление жестового языка в программе SLEd // Труды Международного семинара “Диалог-2000”. Т. 2. — Протвино, 2000. С. 77 – 79.

- SLEd, Computer-based sign language education program, Russia / A. Voskressenski // 6th Conference “Content-Based Multimedia Information Access” — Paris, 2000.

- Паршин Г.Н., Станевский А.Г. Использование технических средств в технологии образования людей с дефектами слуха // XI Международная конференция-выставка “Информационные технологии в образовании”: Материалы конференции.

Ч. V — М.: МИФИ, 2001. С. 19 – 20.

Ч. V — М.: МИФИ, 2001. С. 19 – 20. - http://schools.keldysh.ru/uvk1838/SLDict/daru.htm

- http://www-sim.int-evry.fr/Artemis

«Unacknowledged language» (sing language and computing linguistics)

- L. Voskressenskij

Key words: computer-based animation, deaf, dialogue, translation, dictionary,

gesture-translation, sign language.

Sign language is used by millions people but not attends by linguists. In Russian Federation Russian Sign language (RSL) has status “the language for interpersonal communication”. It’s not possible to create the schoolbooks for non written language. The sign language became “written” only with computer aid. The computer animated signs only enable the possibility to create sign language dictionaries not tied with person of sign demonstrator. There is demonstrated that solution of sign language translation problem needs same means that classical computing linguistics — natural language queries to full-text databases for different data domain, verbal input and output, the coherent text generation using keywords and expressions.

|

Приглашаем студентов пройти соцопрос на тему «Патриотическое воспитание в Российской Федерации» Уважаемые студенты! В рамках реализации мероприятия федерального проекта «Патриотическое воспитание граждан РФ» национального проекта «Образование» Минобрнауки России ведется работа по созданию патриотического движения Ассоциации студенческих патриотических клубов «Я горжусь», формирующего чувство сопричастности истерическому героическому прошлому России. В целях достижения запланированного результата проекта предлагаем пройти опрос на тему «Патриотическое воспитание в Российской Федерации». |

|

Социологическое исследование для преподавателей в связи с переходом к смешанной модели обучения Российская академия народного хозяйства и государственной службы при Президенте Российской Федерации Федерации по поручению Министерства науки и высшего образования Российской Федерации проводит очередное социологическое исследование проблем преподавателей вузов в связи с переходом к смешанной модели обучения. Опрос проводится до 27.07.2021 г. включительно и направлен на оценку ситуации, связанной с реализацией образовательного процесса в условиях распространения и преодоления последствий новой коронавирусной инфекции Covid-19, и анализ особенностей дистанционного образования. Опрос является анонимным, данные будут анализироваться в общем виде. |

|

С 8 по 12 сентября на территории Республики Крым пройдет творческий Фестиваль «Таврида.Арт» В рамках реализации национального проекта «Образование» с 8 по 12 сентября на территории Республики Крым состоится творческий Фестиваль «Таврида.Арт», в котором могут принять участие молодые люди в возрасте от 18 до 35 лет. В случае прохождения федерального отбора участникам будет обеспечен трансфер до места проведения фестиваля и обратно, проживание на Фестивале (палатки) и полноценное участие в программе мероприятия. Фестиваль лидеров изменений «Таврида.АРТ» пройдет в бухте Капсель в Крыму с 8 по 12 сентября. Он объединит все направления искусства и вновь станет самой большой площадкой России для самореализации молодых деятелей культуры, искусств и креативных индустрий. Кроме основной локации под Судаком, яркие шоу в рамках фестиваля пройдут еще в пяти городах Крымского полуострова. |

|

Море, горы, аэропорт: производственная практика студентов-строителей НГАСУ (Сибстрин) на крупнейшей стройке юга России Благодаря стратегическому партнеру университета – ЗАО «ЛОММЕТА» – студенты работают не на обычном объекте, а на крупнейшей стройке России – возведении нового терминала аэропорта «Геленджик» в Краснодарском крае. Современный аэровокзальный комплекс, строительство которого будет завершено в декабре этого года, значительно улучшит транспортную инфраструктуру курортной зоны юга страны. В Геленджик приехали 23 студента 3-5 курсов бакалавриата по профилю «Промышленное и гражданское строительство» и специалитета «Строительство уникальных зданий и сооружений». ЗАО «ЛОММЕТА» оплатило студентам стоимость проезда в Геленджик и обратно, проживание и питание, а также выплачивает заработную плату. Непосредственно производственная практика проходит с 24 июня по 28 июля, однако у желающих есть возможность остаться работать на объекте и после ее окончания. |

Язык тела и голос в виртуальных презентациях

Даже если вы от природы уверенный в себе оратор, очевидно, что ваши действия по привлечению аудитории лично не так эффективны в виртуальном плане.

Возьмем, к примеру, язык тела.

В очных презентациях язык тела (он же невербальное общение) является решающим фактором для правильного понимания.

Некоторое время назад я снял небольшой видеоролик о том, как овладеть искусством языка тела:

А как насчет виртуальных презентаций?

Виртуальные презентации — это отдельная история.

Поскольку видна только часть вас, фокус больше на вашем лице, чем на вашем теле. По сути, вашему телу негде поговорить!

Таким образом, проценты связи меняются местами. В виртуальных презентациях голос и слова приобретают гораздо большее значение, чем язык тела.

Давайте разберемся и посмотрим, как это может выглядеть в успешной виртуальной презентации.

Голос в виртуальной презентации

То, как вы используете свой голос в презентации, зависит от того, какое изображение вы хотите проецировать.Вы хотите быть величественным и авторитетным оратором? Или доступный человек? Или и то, и другое?

Мне нравится использовать аналогию с самолетом, чтобы различать два основных режима речи.

Тип голоса 1: Коннектор

Если вы хотите общаться со своей аудиторией на человеческом уровне, вам нужно говорить как бортпроводник:

Говорите так:

- Быстрее

- Без пауз

- Много музыкальности

- В конце фразы

Тип голоса 2: Достоверный

С другой стороны, если вы хотите передать некоторые серьезные знания своей аудитории и придать себе некоторый авторитет, вам нужно говорить как пилот:

Говорите так:

- Медленно

- С паузами

- Довольно однообразно

- И спуститесь в конце фразы

В какое путешествие ваш голос ведет аудиторию?

Разнообразие очень важно, если вы хотите добиться сильного вокального эффекта!

Думайте о своей презентации как о путешествии или истории — как вы собираетесь добавить к ней свет и тень своим голосом? Как вы собираетесь выделить самые важные моменты?

Язык тела в виртуальных презентациях

Хотя голос является главным в виртуальных презентациях, есть ли еще место для языка тела?

Совершенно верно, но это не будет выглядеть так, как онлайн-презентации.

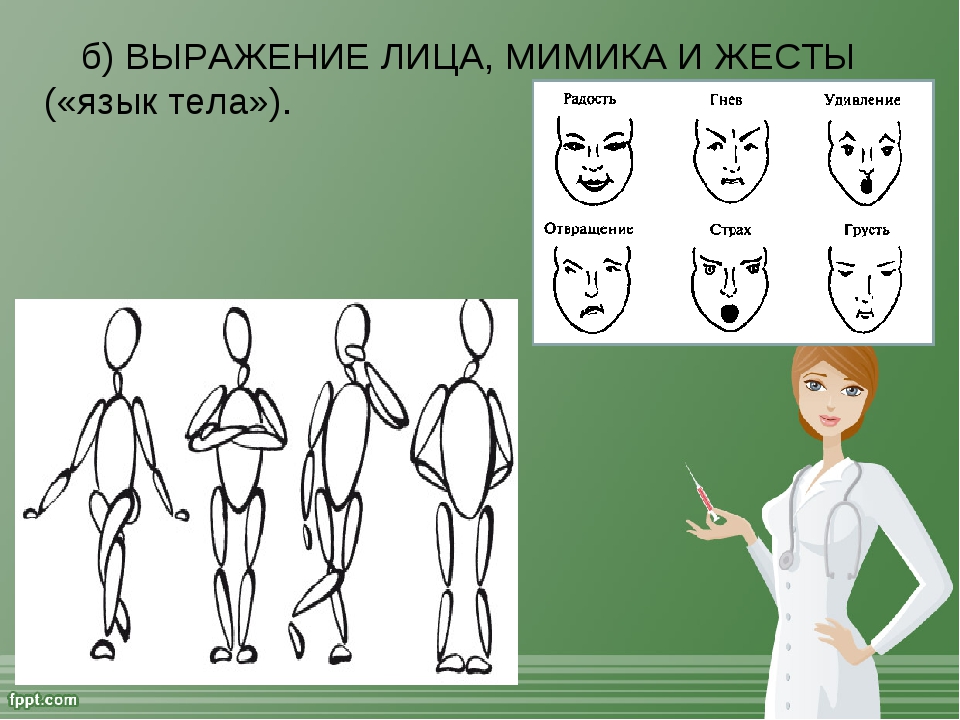

Язык тела — это, по сути, невербальное общение: зрительный контакт, жесты и мимика. В виртуальном ландшафте видна только часть вашего тела, и отправляемые вами сигналы не обязательно улавливаются вашей аудиторией. По-прежнему используйте жесты, если это то, что вы делаете естественно. Если вы выступаете стоя, сначала держите руки рядом с собой.

Однако есть две важные вещи, которые вы можете сделать:

- Смотреть прямо в камеру

- Замените язык тела отличными слайдами

Давайте разберем их один за другим…

Объектив — это окно в душу

В реальной жизни вы можете смотреть в глаза своей аудитории, так что же будет виртуальным эквивалентом? Смотрим в объектив.

Слишком многие ораторы забывают смотреть прямо в камеру. Это вполне возможно, потому что они не уверены, где он находится (особенно если у вас несколько экранов!)

Если вы используете компьютер для презентации, то ваш объектив будет в верхней части экрана — именно там вы должны быть. глядя, а не на других ораторов или собственное лицо.

Получить наглядное пособие

Другой способ заменить язык тела — использовать визуальные элементы, которые вы используете в своей презентации.Это могут быть слайды PowerPoint, видео, интерактивные опросы или многое другое…

Любой, кто пострадал от печально известной «Смерти от PowerPoint», знает, что не все слайды будут интересными.

Фактически, я написал здесь руководство по созданию исключительных онлайн-слайдов.

Выбор правильного фона

Фон в виртуальных презентациях имеет большее значение, чем в реальной жизни. Они создают сцену и дают аудитории невербальные сигналы о вас.

Если у вас есть выбор, попробуйте использовать следующий фон:

- Лаконичный

- Обычная

- Или с функциями, которые усиливают изображение, которое вы хотите спроецировать (например, в моем курсе «Дизайн и доставка» я использую свои книжные полки на заднем плане).

Если в вашем доме нет ничего подходящего, не паникуйте! Здесь может пригодиться виртуальный фон. Вместо хаоса у вас может быть безмятежный офисный фон или изображение с полезной информацией о вашем бизнесе.

Zoom и Microsoft Teams уже имеют встроенные функции виртуального фона, что позволяет легко заменить беспорядок на профессиональный фон.

Если вы используете Skype или Google Hangout для своей презентации, вы можете попробовать Snap Camera.

Вам нужно вдохновение для вашего фона?

- Вот полезный список загружаемых профессиональных фонов на выбор

- Или вы можете создать свой собственный с помощью Canva.

Знаете ли вы? Zoom добавил новую функцию, которая означает, что вы можете заменить виртуальный фон слайдами PowerPoint.Это отличный способ не только спрятать дом, но и сделать слайды более интересными и человечными.

Хотите стать исключительным виртуальным оратором?

В сентябре 2020 года я запускаю совершенно новый курс, призванный превратить новичков и опытных докладчиков в исключительных виртуальных докладчиков.

Он называется Design & Deliver и будет иметь форму видеороликов в уменьшенном размере, сопровождаемых дополнительными учебными материалами. Курс охватывает все, что вам нужно знать, от развития голоса до овладения технологиями, и я также буду предлагать индивидуальные отзывы о презентации.

Хотите узнать больше? Присоединяйтесь к нашему списку рассылки VIP, чтобы первым узнавать, когда курс начнется (и получите скидку 20% в качестве бонуса).

Компьютер, который читает язык тела

Исследователи из Института робототехники Университета Карнеги-Меллона позволили компьютеру понимать позы и движения нескольких людей из видео в реальном времени, включая, впервые, позу пальцев каждого человека.

Этот новый метод был разработан с помощью Panoptic Studio, двухэтажного купола, встроенного в 500 видеокамер.Понимание, полученное в результате экспериментов на этом объекте, теперь позволяет определять позу группы людей с помощью одной камеры и портативного компьютера.

Ясер Шейх, доцент кафедры робототехники, сказал, что эти методы отслеживания двухмерной формы и движения человека открывают новые пути для взаимодействия людей и машин, а также для людей, использующих машины, чтобы лучше понимать мир вокруг них. Например, способность распознавать позы рук позволит людям взаимодействовать с компьютерами новыми и более естественными способами, такими как общение с компьютерами, просто указывая на предметы.

Обнаружение нюансов невербального общения между людьми позволит роботам служить в социальных пространствах, позволяя роботам понимать, что делают люди вокруг них, в каком настроении они находятся и можно ли их прервать. Беспилотный автомобиль может получить раннее предупреждение о том, что пешеход собирается выйти на улицу, отслеживая язык тела. Предоставление машинам возможности понимать поведение человека также может привести к новым подходам к поведенческой диагностике и реабилитации при таких состояниях, как аутизм, дислексия и депрессия.

«Мы общаемся с помощью движения тела почти так же, как и с помощью голоса», — сказал Шейх. «Но компьютеры более или менее слепы к этому».

В спортивной аналитике обнаружение позы в реальном времени позволит компьютерам не только отслеживать положение каждого игрока на игровом поле, как сейчас, но и знать, что игроки делают со своими руками. ноги и головы в каждый момент времени. Эти методы можно использовать для прямых трансляций или применить к существующим видео.

Чтобы стимулировать больше исследований и приложений, исследователи выпустили свой компьютерный код для оценки позы рук и нескольких людей. По словам Шейха, она уже широко используется исследовательскими группами, и более 20 коммерческих групп, включая автомобильные компании, выразили заинтересованность в лицензировании этой технологии.

Шейх и его коллеги представят доклады о своих методах обнаружения нескольких лиц и позы рук на CVPR 2017, конференции по компьютерному зрению и распознаванию образов, 21–26 июля в Гонолулу.

Отслеживание нескольких людей в режиме реального времени, особенно в социальных ситуациях, когда они могут контактировать друг с другом, представляет ряд проблем. Простое использование программ, отслеживающих позу человека, не работает для каждого человека в группе, особенно когда эта группа становится большой. Шейх и его коллеги использовали восходящий подход, который сначала локализует все части тела в сцене — руки, ноги, лица и т. Д. — а затем связывает эти части с конкретными людьми.

Проблемы с обнаружением рук еще больше. Поскольку люди используют руки для удержания предметов и жестов, камера вряд ли увидит все части руки одновременно. В отличие от лица и тела, не существует больших наборов данных с изображениями рук, которые кропотливо помечены метками частей и положений.

Но для каждого изображения, которое показывает только часть руки, часто существует другое изображение под другим углом с полным или дополнительным изображением руки, сказал Ханбёль Джу, доктор философии.D. студент по робототехнике. Вот где исследователи использовали многокамерную Panoptic Studio CMU.

«Один снимок дает вам 500 изображений руки человека, плюс он автоматически аннотирует положение руки», — объяснил Джу. «Руки слишком малы, чтобы их можно было комментировать с помощью большинства наших камер, поэтому для этого исследования мы использовали только 31 камеру высокого разрешения, но все же смогли собрать массивный набор данных».

Джу и Томас Саймон, еще один доктор философии. студент, своими руками набрал тысячи просмотров.

«Panoptic Studio развивает наши исследования», — сказал Шейх. Сейчас он используется для улучшения детекторов тела, лица и рук путем их совместного обучения. Кроме того, по мере продвижения работы по переходу от двухмерных моделей людей к трехмерным моделям, способность объекта автоматически генерировать аннотированные изображения будет иметь решающее значение.

Когда Panoptic Studio была построена десять лет назад при поддержке Национального научного фонда, было неясно, какое влияние она окажет, сказал Шейх.

«Теперь мы можем преодолеть ряд технических барьеров, в первую очередь благодаря гранту NSF 10 лет назад», — добавил он.«Мы делимся кодом, но мы также делимся всеми данными, собранными в Panoptic Studio».

Помимо Шейха, в исследование по оценке позы с участием нескольких человек входили Саймон и магистранты Чжэ Цао и Ши-Энь Вэй. В исследовании по обнаружению рук участвовали Шейх, Джу, Саймон и Иэн Мэтьюз, адъюнкт-преподаватели Института робототехники. Хинес Идальго Мартинес, магистрант, также участвует в этой работе, управляя исходным кодом.

Инициатива CMU AI в Школе компьютерных наук продвигает исследования и образование в области искусственного интеллекта, используя сильные стороны школы в области компьютерного зрения, машинного обучения, робототехники, обработки естественного языка и взаимодействия человека с компьютером.

3 совета, как выделиться для вашей следующей виртуальной презентации — Present Perfect

Как лучше работать из дома: задний план (не потолок), положение камеры (избегая заглядывания в нос) и технические настройки — все это было подробно рассмотрено за последние несколько недель. Однако то, как использовать язык тела, чтобы сохранить ту же харизму, что и на виртуальной презентации, и при личной встрече, является важным фактором, которым мы не можем пренебречь. (#SameButDifferent на расстоянии)

Работа на дому, также известная как «телетравейл», была растущей тенденцией во Франции

(я имею в виду, кому не нравится, носить пижамные штаны… или вообще не носить штаны на работе… что бы там ни было на вашей лодке). В последнее время, когда большая часть мира находится в изоляции от covid19 или добровольно пытается дистанцироваться от общества, многие из нас были брошены в глубокий конец и теперь обнаруживают, что работают из дома и участвуют в онлайн-встречах команды; показывать виртуальные презентации красивой мозаике коллег или клиентов на нашем экране.Это стало для нас новой реальностью, к которой нам нужно адаптироваться… быстро.

Как будто публичный говорить было недостаточно страшно само по себе, дополнительные проблемы, такие как технические проблемы, разговор с экраном компьютера и настройка нашего тела язык; теперь добавили к тому беспокойству, которое некоторые уже могли испытывать при доставке презентации. Компании удивляются сколько в остальном профессиональных и эффективных сотрудников неэффективно правильно настроить смартфон или компьютер и адаптировать язык их тела для создания профессионального имиджа сами, когда на видеозвонок из дома.

Само собой разумеется, что виртуальные презентации отличаются от личных встреч, но полезно смотреть на вещи в перспективе. Суть вашей презентации остается прежней, поэтому, если у вас есть опыт презентации лично, вы сможете перейти к дистанционной презентации с небольшими изменениями.

1 — ВАЖНОСТЬ ЯЗЫКА ТЕЛА

Даже когда мы убираем общее физическое пространство презентации, язык тела по-прежнему остается одним из самых важных факторов в общении… период.Когда вы разговариваете с кем-то, во время виртуальной презентации или встречи, кто присутствует и вовлечен и использует весь свой набор инструментов, состоящий из мимики и плавных жестов для общения; легко забыть, что вы с ними не в одной комнате.

Ваше «присутствие» все еще может быть очень заметным, даже когда вы не присутствуете физически.

- Не надо статичны только потому, что вы сидите. Раскройте руки и впитайте жидкость жесты во время разговора.

- Поднимите брови и используйте все свои способности мимики, чтобы выглядеть более заинтересованными и присутствовать перед аудиторией….И, конечно, не забывайте улыбаться… 😊

- Говорите через диафрагму, чтобы сильное и чистое качество голоса. Для этого нужно сесть прямо и напрячь мышцы живота во время разговора.

- Поддерживайте зрительный контакт со своей аудиторией, выключив камеру для селфи (это как магнит для внутреннего нарцисса, который живет в каждом из нас) и сядьте на расстоянии вытянутой руки от компьютера или ноутбука. Это уберет изображение, которое мы смотрим на экран, и создаст впечатление, что мы смотрим аудитории прямо в глаза.

2 — ВАЖНОСТЬ ВАШЕЙ ВИРТУАЛЬНОЙ АУДИТОРИИ… НЕ ВАС

Представляя виртуальную встречу, мы сосредотачиваемся на том, чтобы видеть других; и часто забываем, что нас видели!

Подобно публичным выступлениям в целом, мы склонны уделять много внимания себе и тому, как нас воспринимают, тогда как нам действительно следует сосредоточиться на нашей аудитории и на том, как они интерпретируют / понимают наше сообщение.

Выделитесь и позвольте своей презентации произвести впечатление на вашу аудиторию:

- Не сиди так рядом с вашим компьютером / ноутбуком, чтобы ваша аудитория могла заметить чистые поры с последнего ночная процедура для лица #lockdownbeautysalon.

- Это не менее важно не скрываться от встречи, сидя так далеко, аудитория больше не может видеть ваше выражение лица. Сядьте на расстоянии 80 см от ваш экран. Проверьте камеру (перед выключением), чтобы убедиться, что хорошо видны плечи, верхняя часть рук и лицо. Таким образом, ваш адаптированный язык тела будет более заметным, и ваша доставка будет иметь большее влияние, поскольку в отличие от просто еще одного пустого лица на экране.

- Теперь, очередь выключить селфи-камеру (зачем отвлекать вас от себя)

- Вовлеките со своей аудиторией, как если бы они были в одной комнате с вами.Задайте риторический вопрос вопросы и назовите чье-то имя, если хотите включить его в беседа. Свяжитесь с ними перед тем, как начать презентацию: «Привет! все, как к вам относятся в домашнем офисе? »

- Не бойтесь силы тишины! Использование целенаправленной паузы (что означает, что вы планируете ее) позволяет сообщениям проникнуть внутрь, они дают аудитории секунду, чтобы усвоить то, что вы сказали, они дают вам секунду, чтобы перевести дыхание, прежде чем перейти к следующему пункту. , и они не позволяют презентации стать слишком монотонной и слишком длинной (как это предложение)

* Примечание. Когда вы используете паузу, убедитесь, что ваша аудитория не думает, что ваш экран завис.Продолжайте улыбаться и кивайте головой, чтобы дать понять, что вы все еще здесь, и двигайтесь дальше через приличные 2–3 секунды.

3 — ПОДГОТОВКА НАЗНАЧЕНИЯ

В Present Perfect мы знаем, что подготовка так же важна, как и сама презентация, и это не меняется для виртуальных презентаций.

Ваша уверенность и присутствие исходят от подготовки.

- Знай свое аудитория. Знание того, к кому вы будете обращаться, повлияет на то, как вы хотите быть воспринимается; таким образом, влияя на ваше сообщение и ваш язык тела.Мой виртуальный встречи с моей командой сильно отличались от моих онлайн-тренингов и коучинговые сессии. (Надеть штаны кажется более важным по крайней мере для одного из те)

- Знайте свое сообщение. Если вы не можете выразить суть вашей презентации одним предложением, возможно, сообщение недостаточно ясное. Знайте, как вы зацепите свою аудиторию, свои ключевые аргументы / пункты и что вы хотите, чтобы они делали с этой информацией после вашей виртуальной презентации (также известной как призыв к действию).

- Знать себя: легче понять, как справиться со стрессом, когда мы знаем, «как» стресс в первую очередь.Вы быстро говорите? Включите паузы в свой презентация. Вы много ерзаете, когда говорите? Раскройте руки и используйте жидкость жесты, чтобы не хватать ручку или играть с волосами. Чтобы поймать и поправьте эти маленькие «автоконтакты», снимите себя во время подготовки.

- Язык вашего тела формирует вашу личность. «Не притворяйся, пока не сделаешь это, не притворяйся, пока не станешь им» — наша любимая цитата исследовательницы Эми Кадди. Она предлагает использовать силовые позы в качестве метода подготовки перед любой встречей, чтобы заставить наше тело думать, что мы очень уверены в себе.Проведите 2 минуты, стоя прямо и заземленно, делая глубокие вдохи, и исследования показывают физиологический и психологический сдвиг в нашем уровне стресса.

Знание, с кем вы будете разговаривать, и то, как адаптировать язык тела к вашему сообщению и виртуальной ситуации, являются ключевыми инструментами для создания мощной и эффективной виртуальной презентации. Выделитесь из онлайн-мозаики лиц во время встречи и подчеркните свое «присутствие», даже если вы не присутствуете физически #samebutdifferent

Как ИИ революционизирует то, как мы используем язык тела

Эта статья является частью нашего руководства по языку тела.Щелкните здесь, чтобы узнать больше.Мало что может быть более разрекламированным, чем грядущая революция в области ИИ. Миллиардеры борются за то, спасет ли ИИ нас или проклянет нас, и большая часть будущих перспектив ИИ все еще остается без ответа. Но когда дело доходит до приложения ИИ к языку тела, будущее уже наступило. Просто он еще не получил широкого распространения. В этом посте мы исследуем, как вы уже можете воспользоваться некоторыми недавними достижениями ИИ, а также способы, которыми ИИ уже применяется в мире.

Примечание: Вы не знакомы с ИИ? Стэнфорд предлагает здесь отличный учебник.

Как компьютеры читают язык тела

Краткий ответ? Краткого ответа нет. Заставить компьютеры понимать язык человеческого тела — непростая задача. Давайте разберем шаги, необходимые компьютеру, чтобы хорошо понять, что говорит ваш язык тела. Эти скриншоты взяты из презентации wrnch на конференции NVIDIA в 2018 году.

Обнаружение ключевых точек

Во-первых, компьютер должен видеть.Итак, ему нужна камера. Это достаточно просто — на Земле больше фотоаппаратов, чем людей. Но компьютер не видит, как мы, он только получает поток данных с камеры. Итак, программное обеспечение сначала должно распознать форму человеческого тела, а затем обозначить ключевые точки нашей анатомии.

Некоторым бедным душам приходилось учить компьютер тому, как выглядит колено, плечо, локоть и все наши различные части тела, в самых разных условиях освещения и во множестве разных типов телосложения.

Затем они должны были сделать то же самое с лицом. Вы можете увидеть, как ИИ Google отобразил мое лицо на изображении ниже.

Почему это важно? Ну, потому что это позволяет компьютеру превращать физический мир в математику. Вот пример данных, полученных с моего изображения выше:

{

«faceAnnotations»: [

«ориентиры»: [

{

«тип»: «LEFT_EYE»,

«позиция»: {

«x»: 170.85728,

«y»: 183.1824,

"z": 0.0037799156

}

},

{

"type": "RIGHT_EYE",

"position": {

"x": 263.8876,

"y": 182.71136,

"z": - 3.4158726

}

},

{

"тип": "LEFT_OF_LEFT_EYEBROW",

"позиция": {

"x": 141.12056,

"y": 164.7338,

"z": 5.355021

Компьютеры любят математику.Они это понимают. Им это нужно. Итак, теперь у компьютера есть карта каждой части нашего тела, которую он может понять.

↑ Содержание ↑

Ключевые моменты вместе составляют тело

Но понимание того, что изображение содержит локоть, колено или лицо, не приносит особой пользы. Итак, затем компьютер рассматривает все эти точки вместе и, взяв то, что он знает о том, как должно быть собрано тело, соединяет точки. Вы можете увидеть это наглядно ниже.

Здесь стоит обратить внимание на одну особенность. Посмотрите, что на изображении ниже есть дополнительные точки (или координаты, на которые компьютер обращает внимание) в двух областях… руках и лицах. Мы знаем, что передаем огромное количество информации с помощью мимики и жестов рук. Итак, компьютер еще ближе смотрит на эти две области, чтобы, так сказать, «получить полную картину».

↑ Содержание ↑

Теперь мы выводим эмоции из этой формы

Итак, теперь компьютер знает, как преобразовать изображение с камеры в форму нашего тела или нескольких тел.Он уделяет пристальное внимание нашим лицам и рукам. А теперь самое простое — по крайней мере, для людей. Приписывание эмоций или намерений языку тела и выражению лица буквально заложено в наших генах, поэтому это происходит довольно легко.

Но компьютеры понятия не имеют! Здесь на помощь приходят модели машинного обучения. Проще говоря, компьютерам необходимо увидеть массу примеров любого конкретного языка тела, чтобы затем им было сказано, что это за язык тела или что он означает, и затем они могут со временем и с все большим количеством примеров идентифицировать то же самое или похожая позиция с этой эмоцией.

Видео ниже, опять же от wrnch, отлично иллюстрирует этот принцип. На видео вы можете увидеть различные физические выражения лиц. Затем, когда программное обеспечение распознает их как жест, оно заменяет часть тела, делающую этот жест, эквивалентным смайликом.

↑ Table of Contents ↑

Вывести действия из контекста

Вот где происходит настоящее волшебство. Понимание жестов — одно (очень впечатляющее) достижение.Но для того, чтобы действовать в соответствии с ними, необходим дополнительный уровень информации: ситуационный контекст. Возьмите приведенные выше примеры. Люди машут руками или показывают «Стоп!» Но как мне, как компьютеру, действовать на основе этой информации? Это зависит.

Если я — беспилотный автомобиль, приближающийся к пешеходному переходу, и вижу перед собой опущенную руку, я могу сделать вывод, что человек хочет, чтобы я остановился, поскольку он намеревается перейти улицу. Если вместо этого я увижу того же человека, использующего жест «двигаться вперед», это явный признак того, что он предпочел бы, чтобы я продолжил свое путешествие, а не ждал.Автомобиль только что прочитал ваш язык тела, добро пожаловать в будущее!

↑ Содержание ↑

Приложения использования ИИ для чтения языка тела

Для начала я бы очень порекомендовал посмотреть отличный выступление на TED Talk под названием: Технология, которая знает, что вы чувствуете :

↑ Содержание ↑

Здоровье

Сфера здравоохранения будет коренным образом преобразована за счет применения искусственного интеллекта. Знаете ли вы, что 50 процентов женщин, которым сообщили, что у них рак груди, на самом деле здоровы? Был разработан искусственный интеллект, который повысил точность диагностики рака до 99 процентов и сделал это примерно в 30 раз быстрее, чем люди.Теперь, если это не мешает, я не знаю, что это такое!

Google недавно сотрудничал с офтальмологической клиникой, где они применили ИИ для трудоемкой диагностики различных заболеваний глаз. Из их сообщения:

Время, необходимое для анализа этих сканирований, в сочетании с огромным количеством сканирований, которые должны проходить медицинские работники (более 1000 в день только в Мурфилдсе), может привести к длительным задержкам между сканированием и лечением — даже если кому-то срочно требуется уход. Если у них разовьется внезапная проблема, такая как кровотечение в задней части глаза, эти задержки могут даже стоить пациентам их зрения.

Разработанная нами система направлена на решение этой проблемы. Он не только может автоматически обнаруживать признаки глазных заболеваний за секунды, но также может определять приоритеты пациентов, которые больше всего нуждаются в неотложной помощи, и рекомендовать их для лечения. Этот процесс мгновенной сортировки должен значительно сократить время между сканированием и лечением, помогая людям, страдающим диабетическим заболеванием глаз и возрастной дегенерацией желтого пятна, избежать потери зрения.

Получение более быстрой, точной и дешевой медицинской помощи? Это должно стать победой для всех.

↑ Содержание ↑

Безопасность и защита

Возможно, одним из величайших приложений искусственного интеллекта на языке тела будет помощь и повышение интеллекта и действий профессионалов в области безопасности и защиты. Эти люди должны принимать решения за доли секунды, которые могут означать жизнь и смерть. Они полагаются на обучение и тонко настроенные инстинкты, но они все еще люди. Если они ошибаются, жизни людей в опасности.

Массачусетский технологический институт уже разработал носимые устройства, использующие искусственный интеллект для распознавания тона разговора.Представьте себе противостояние между переговорщиком о заложниках и преступником, в котором вы можете отслеживать мельчайшие изменения тона голоса и помочь довести кризис до мирного исхода. Представьте себе контрольно-пропускной пункт для паспортов, где пограничник в режиме реального времени получает информацию о вашей нервозности и честности.

↑ Содержание ↑

Маркетинг

Современные маркетологи любят данные. Мы все видели, на что Facebook пойдет, чтобы узнать больше о своих пользователях, чтобы рекламодатели могли показывать более релевантную рекламу.Представьте, могут ли они показывать вам различную рекламу в зависимости от вашего настроения? Вы, вероятно, не захотите видеть определенные виды рекламы, когда вы злитесь, и точно так же рекламодатели, вероятно, захотят показать вам, когда вы в хорошем настроении.

Откуда они могли это знать? Взгляните на устройство, которое вы используете прямо сейчас — на нем есть камера, которая очень способна предоставить данные о ваших выражениях лица. Почему бы не попробовать самому? Ту же технологию можно использовать, чтобы узнать, нравится ли вам или не нравится то, что вы смотрите, чтобы автоматически оценить вашу реакцию на фильмы, политику и т. Д.Надеюсь, конечно, все это сделано с вашего разрешения. Но технология существует сегодня, чтобы прочитать вашу внутреннюю реакцию на все, что вы смотрите!

↑ Содержание ↑

Испытайте ИИ на себе

Я твердо верю, что ИИ находится на пороге великого времени, а не прихоти. Итак, я хотел посмотреть, как мы можем начать использовать все больше и больше ИИ здесь, в Science of People. Давайте попробуем провести пару тестов и посмотрим, что у нас получится. Я сел с Ванессой и снял короткую видеодемонстрацию двух API Google, связанных с языком тела.

↑ Содержание ↑

Определение эмоций по собственным фотографиям

Раньше мы уже много писали о том, как важно показывать правильные эмоции на фото профиля. Используя Google Vision API, теперь есть некоторая помощь ИИ, которая поможет вам разобраться в эмоциях, которые вы показываете на фотографии вашего профиля или любой фотографии, если на то пошло.

Вернемся к моему примеру сверху.

Вы можете видеть, как точно Google нанес на карту ключевые точки моего лица, превратив их в координаты.Затем он может определить общую форму моего лица и интерпретировать эмоции, которые я проявляю:

Итак, это удалось. Но как насчет чего-нибудь следующего уровня? Если я проверю полный ответ API Google для этого изображения, я найду следующую запись:

"bestGuessLabels": [

{

"label": "муж ванессы ван Эдвардс",

"languageCode": "en"

}

Google не только знает, кто такая Ванесса или я, но и знает, что мы женаты! Теперь, если это не Скайнет, я не уверен, что это такое.

↑ Содержание ↑

Мы также довольно много говорим о прайминге в Science of People. API естественного языка Google может помочь нам заглянуть за слова, которые мы используем на регулярной основе, и увидеть, не можем ли мы непреднамеренно вызвать непреднамеренную эмоцию или сущность.

Я взял следующую копию со страницы «О нас» и прогнал ее через API, чтобы проверить, не отправляем ли мы на этой странице какой-либо непреднамеренный эмоциональный подтекст.

Мне всегда хотелось знать, как работают люди.Что движет нашим поведением? Почему люди поступают именно так? И, самое главное, можете ли вы предсказать и изменить поведение?

Вот что вернул Google, проанализировав каждый раздел копии на предмет своего мнения.

Вы можете увидеть одно предложение: «Почему люди поступают именно так?» получил отрицательную оценку настроения. Вне контекста это может иметь негативный оттенок. Учитывая его место среди остальной части этой копии, а также остальной части этой страницы (которую я не скармливал через API), я думаю, что это все еще в порядке.

Возможно, вы захотите проверить свою короткую биографию в LinkedIn, свой профиль в Twitter или любую другую биографию о себе или своем бизнесе, чтобы узнать, не посылаете ли вы непреднамеренно негативные сигналы своим выбором слов.

↑ Содержание ↑

Заключение

Надеюсь, теперь у вас есть лучшее представление о том, как компьютеры эволюционировали, чтобы читать язык человеческого тела, а также о многих приложениях, уже существующих и тех, которые появятся в ближайшем будущем.

Я хочу спросить вас, каким вы видите влияние ИИ на язык тела и взаимодействие человека с компьютером в будущем.В частности, как вы думаете, есть ли инструмент или услуга, которые Science of People могла бы создать, чтобы использовать огромную мощь ИИ и помочь вам в повседневной жизни? Дайте нам знать в Твиттере!

Эта статья является частью нашего руководства по языку тела. Щелкните здесь, чтобы узнать больше.Компьютерное зрение для языка тела — как это работает и как его можно использовать

Как люди, мы часто можем понять настроение, намерения и будущие действия другого человека, просто взглянув на него. Мы видим их позу, выражение их лиц, на чем сфокусированы их глаза, и можем получить хорошее представление о том, что они могут делать дальше.Проблему компьютерного зрения для языка тела решить гораздо сложнее, но мы действительно добиваемся прогресса.

На этой неделе у нас в гостях Пол Крушевски, доктор компьютерных наук, который почти 20 лет посвятил себя 3D-моделированию и искусственному интеллекту. Сегодня он генеральный директор Wrnch, монреальской компании по искусственному интеллекту, специализирующейся на чтении и понимании языка человеческого тела.

Пол объясняет, как успехи в 3D-моделировании и компьютерном зрении позволили исследователям заставить машины «понимать» позу, движения и намерения человека, а также помогает исследовать будущие приложения, которые эта технология может иметь в сфере безопасности и розничной торговли. , спорт и многое другое.

Слушайте полное интервью ниже на Soundcloud:

_______________Гость: Пол Крушевски, генеральный директор Wrnch

Опыт: Компьютерное зрение, 3D-моделирование, строительные компании, AI для видеоигр

Краткое признание: Пол получил степень магистра и доктора компьютерных наук в Университете Макгилла. В 2000 году он основал AI.implant, промежуточное программное обеспечение для искусственного интеллекта, используемое компаниями, занимающимися видеоиграми, и продал компанию Engenuity.В 2007 году он основал Grip Entertainment, компанию искусственного интеллекта для игровых приложений, которую продал Autodesk. Wrnch может похвастаться Марком Кубаном как одним из своих инвесторов и советников.

Большая идея

«Передовые технологии компьютерного зрения будущего будут определяться потребностью в большей безопасности и большей защищенности»

Пол считает, что многие из начальных вариантов использования интеллектуального компьютерного зрения для движения тела и тела язык будет определяться потребностями безопасности. Он перечисляет ряд потенциальных ранних приложений:

- Камера, подключенная к домашнему устройству, похожему на Alexa, которое может определить, упал ли кто-нибудь в доме, или идет / ведет себя странно (эта технология может позволить взрослым детям лучше контролировать свои пожилые родители)

- Камеры видеонаблюдения, которые не только обнаруживают движение или обнаруживают людей, но и поведение людей (например, люди, крадущие предметы из магазина или тихо крадущиеся за пределами дома)

- Камеры на автономных автомобилях, которые могут считывать язык тела или выражение лица пешеходов или пассажиров (автомобиль в будущем должен иметь возможность определять, смотрит ли пешеход в свой телефон и идет одновременно, потому что такие люди с большей вероятностью переходят дорогу в неподходящее время)

(Для читателей, которые больше интересуются физической безопасностью и технологиями информационной безопасности, ознакомьтесь с нашей полной статьей об искусственном интеллекте в целях безопасности.)

Основные моменты интервью с Полом Крушевски из Wrnch

Ниже перечислены некоторые из основных вопросов, которые задавались Полу на протяжении всего интервью. Слушатели могут использовать встроенный проигрыватель подкастов (вверху этого поста), чтобы перейти к разделам, которые могут быть им интересны:

- (3:15) Говоря простым языком, как можно обучить компьютеры понимать части тела и осанку? ?

- (9:25) Какие приложения компьютерного зрения нужны машинам для понимания позы и намерений человека? Каковы бизнес-сценарии использования?

- (11:00) Как можно использовать подобные технологии для домашней безопасности — как расширение Alexa?

- (15:30) Каковы некоторые применения этой технологии в области автономных транспортных средств или транспорта?

- (20:00) В следующих 5-10 технологиях, каковы будут наиболее важные последствия такого «умного» компьютерного зрения для предприятий и правительств?

Советы на языке тела для проведения видеовстреч

Кэтлин Морец внесла несколько изменений в свой язык тела, увидев себя на экране компьютера во время виртуальных встреч, когда вся ее команда начала работать удаленно.

Теперь она кивает, когда говорит коллега, и улыбается, и смотрит в веб-камеру, когда к ней обращаются.

«Я всегда обращал внимание, но это не обязательно выглядело так, как всегда», — сказал Морец, руководитель проекта клинических испытаний Института клинических исследований Дьюка. «Это был полезный опыт — научиться кивать и улыбаться во время встречи, чтобы показать, что я заинтересован и слушаю».

Морец подобрал указатели для практики позитивного языка тела во время курса Duke Learning & Organization Development «Общение с помощью дипломатии и такта» в июле.Занятия, которые снова запланированы на 1 октября, предлагают советы по разрешению конфликтов, дают обратную связь и общаются лично, по телефону и посредством виртуальных встреч.

Дон Шортслеф, старший практикующий специалист L&OD, который вел курс, сказал, что язык тела во время виртуальных встреч важен, потому что мимика, жесты рук и поза могут помочь вам эффективно общаться и сотрудничать с коллегами, демонстрировать внимательность и укреплять доверие.

«Если вы видите, что кто-то сутулится, или он не моргает и никак не реагирует, легко предположить, что он не слушает», — сказал Шортслеф.«Простые настройки языка тела, такие как улыбка или кивание, могут иметь большое значение для убеждения ваших коллег в том, что вы слушаете, участвуете и понимаете то, что они говорят».

Вот четыре совета, как улучшить язык тела на виртуальном рабочем месте.

Выразите себя

Дэйв Соллоуэй усиливает лицевую реакцию во время видеовстреч. Он поднимает брови, то встает прямо, то наклоняется вперед, кивая и улыбаясь.

Все это поведение — способ Соллоуэя бороться с его естественным покоем, которое, по его словам, люди могут интерпретировать как бескорыстное.

«Люди могут определить, как вы себя чувствуете, по шестидюймовому изображению вас на экране», — сказал Соллоуэй, помощник директора дневной службы карьерного роста MBA в Школе бизнеса Fuqua. «Это означает, что каждое моргание, каждая улыбка и каждый раз, когда вы наклоняетесь к камере, обладают гораздо большей силой, потому что они не могут интерпретировать всю энергию вашего тела.”

Соллоуэй, который готовит студентов к сетевым взаимодействиям и собеседованиям в Центре управления карьерой Fuqua, рекомендует найти несколько невербальных сигналов, которые сообщают, что вы обращаете внимание. Он рекомендует кивать, поднимать вверх большие пальцы или поднимать брови, чтобы продемонстрировать интерес.

«Вы хотите быть более оживленным», — сказал Соллоуэй. «Это поможет вашей аудитории понять ваше сообщение и поможет докладчикам узнать, что вы заинтересованы».

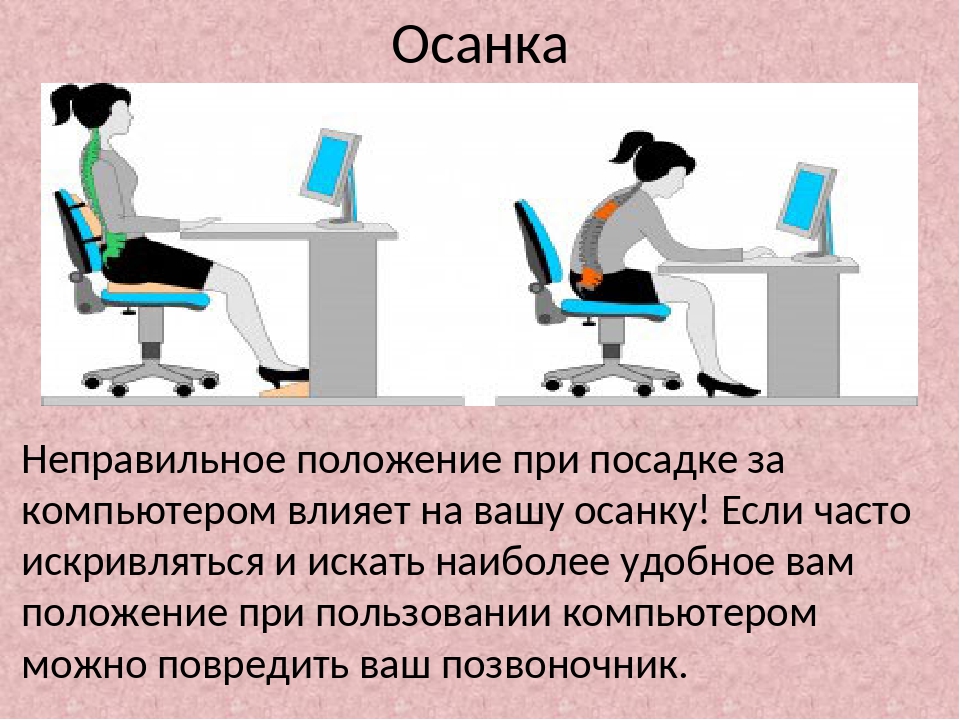

Выпрямите осанку

Секрет Дона Шортслефа сохранять хорошую осанку и держать спину прямой во время виртуальных встреч заключается в том, что все взгляды обращены на него.

«Это не очень хорошо, если вы сгорбились над компьютером, смотрите вниз или валялись на диване», — сказал Шортслеф. «Вы могли бы говорить правильные вещи, но ваше тело передает 1000 негативных сигналов. Люди запомнят этот негатив ».

Чтобы улучшить осанку, держите ступни на полу, а бедра на уровне пола, так чтобы колени находились под углом 90 градусов. Когда вы стоите, ваша голова, шея, спина и ноги должны быть выровнены. В сидячем положении сядьте прямо, чтобы ваши уши, плечи и бедра были на одной линии.

Хорошая осанка делает вас более энергичным, уверенным в себе и снижает нагрузку на ваше тело. Шорслеф сказал, что правильная осанка помогает ему сосредоточиться и настроиться на работу.

«Сидя прямо, я чувствую себя более вовлеченным, более уверенным и более профессиональным», — сказал Шортслеф. «Я считаю, что даже мой голос передает больше силы и интереса».

Оставьте место для ваших рук

Как человек, который жестикулирует руками во время разговора, Кэролайн Горхэм имеет привычку ставить свой стул в нескольких дюймах от своего стола, когда начинается видеовстреча.

Горхэм держит компьютер на расстоянии вытянутой руки, так что коллеги видят ее плечи и руки, пока она разговаривает во время собраний персонала и виртуальных встреч с клубом «PRATTically Speaking Toastmasters».

«Когда вы вырезаете мне руки, вы получаете только половину того, что я говорю», — сказал Горхэм, исполнительный помощник директора Duke Energy Initiative. «Говорить руками — это мой способ показать азарт и энтузиазм. Я метафорически втягиваю вас в разговор.”

Соллоуэй из школы бизнеса Fuqua сказал, что сидение на расстоянии вытянутой руки от экрана — идеальное расстояние для виртуальной встречи. Вы должны быть достаточно близко, чтобы ваши коллеги могли ясно видеть ваше лицо, и достаточно далеко, чтобы оно не выглядело как парящая голова. Старайтесь видеть голову, плечи и верхнюю часть туловища.

«Лучшие ораторы, которых я видел, держат руки в кадре», — сказал Соллоуэй. «Не так приятно видеть только чью-то голову, потому что мы привыкли видеть все его тело, когда разговариваем с ним.Наблюдение за тем, как кто-то двигает плечами и жестикулирует, создает гораздо более естественное и увлекательное ощущение для ваших виртуальных разговоров ».

Зрительный контакт

Чтобы воспроизвести взгляд в глаза, смотрите прямо в веб-камеру.

Моретц из Института клинических исследований Герцога поочередно смотрит прямо на веб-камеру и экран компьютера, когда разговаривает во время встреч.

Если вы набираете заметки в Интернете, размещайте заметки на том же экране компьютера, что и ваша виртуальная встреча.Помещение заметок на отдельный экран создает впечатление, что ваше внимание находится в другом месте. Продолжайте время от времени поглядывать на экран, если делаете заметки от руки. Также отключите микрофон, чтобы звуки набора текста не отвлекали других.

Говорите языком тела

У Соллоуэя есть несколько уловок, позволяющих беззвучно указывать, когда ему есть что сказать во время виртуальной встречи.

Он поднимает подбородок и руку или палец. Участники собрания также могут использовать кнопку, которая выглядит как поднятая рука в Zoom, Microsoft Teams и WebEx, чтобы показать, что вы хотите выступить.

«Мы все могли бы лучше обращать внимание на то, как долго мы говорим, и признавать других, если им есть что сказать», — сказал Соллоуэй. «Когда кто-то использует свое лицо, чтобы выразить любопытный взгляд, и поднимает руку, обычно это знак, что ему есть что сказать. Точно так же все мы знаем, что поднятие руки означает, что вы хотите говорить ».

Есть что-то, что вы хотели бы, чтобы мы осветили? Отправляйте идеи, поздравления и фотографии через нашу форму идеи для рассказов или пишите для использования в working @ duke.edu.

Виртуальный язык тела ExecuNet

Коммуникационные технологии полностью изменили способ общения с людьми для ведения бизнеса. Это открыло глобальные рынки и способствовало использованию географически разнесенных команд, включая организации с несколькими площадками, а также удаленную или домашнюю работу.

Но не все технологии одинаковы. Бережливые технологии, такие как текстовые сообщения и электронная почта, предлагают ограниченные социальные сигналы. Когда вы добавляете голос и изображение, вы используете гораздо более богатые источники общения. Мы родились с врожденной способностью общаться посредством поз, жестов, мимики и вокальной просодии. Фактически, наш мозг ищет и ожидает эти самые примитивные и важные каналы информации. По словам доктора Томаса Льюиса (специалиста по психобиологии эмоций и доцента клинической психиатрии Калифорнийского университета в Сан-Франциско), когда нам отказывают в этих межличностных сигналах, мозг испытывает трудности и страдает реальное общение.

Нет сомнений в том, что использование визуальной среды может быть мощным способом связи с людьми, но однажды я наблюдал, как генеральный директор делал целую видеопрезентацию, склонившись над заметками на столе перед ним, в то время как аудитория (вся его организация , так как это было мероприятие «все руки») осмотрел макушку. Затем, поскольку камера находилась слишком близко к нему, когда он иногда поднимал глаза, движения его глаз выглядели преувеличенными (что заставляло его казаться взволнованным), а его руки продолжали входить и выходить из кадра, когда он жестикулировал.

Эффективное использование визуальных технологий приходит с практикой и опытом. Вот шесть приемов, которые следует помнить при следующей видеоконференции:

Этот пост зарезервирован для участников с VIP-доступом. Станьте участником VIP-доступа или войдите в систему, если вы уже являетесь участником VIP-доступа ExecuNet. У

VIP-членов есть доступ к более чем 100 событиям в прямом эфире, доступной для поиска библиотеке, содержащей более 2000 статей и видео, скидки на последние книги, возможность подавать заявки на все проверенные руководящие должности ExecuNet, видимость для сотен руководителей рекрутеров и многое другое …